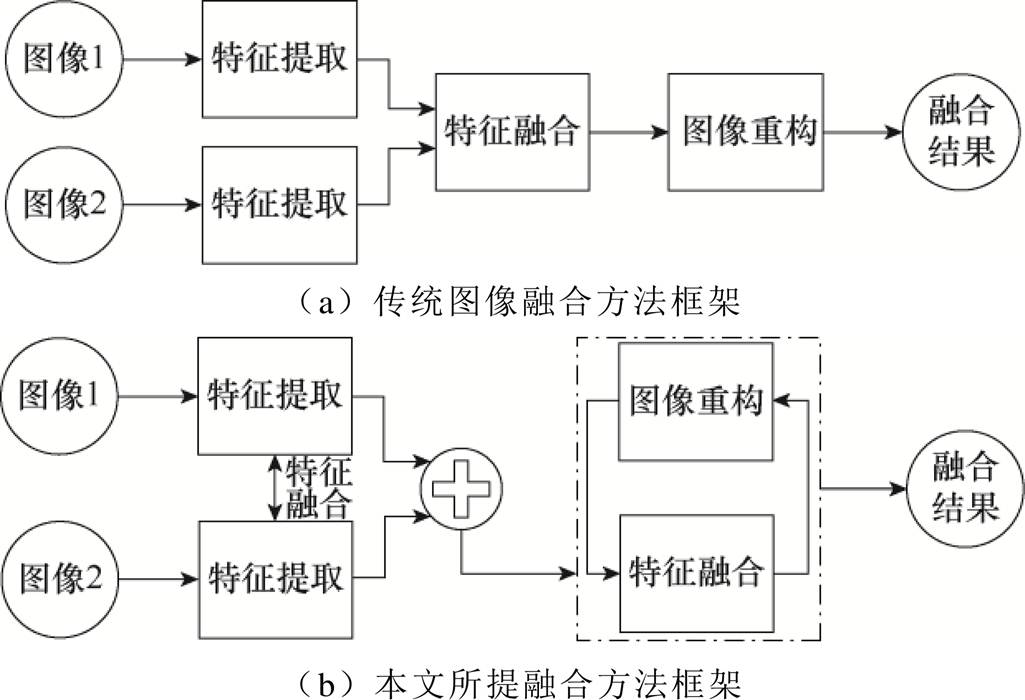

图1 融合方法框架对比

Fig.1 Comparison of fusion method frameworks

摘要 红外图像中变电设备自动识别是实现缺陷与故障诊断的关键步骤。然而,当前红外图像中的变电设备识别面临准确率低和效率差等问题,这主要源于设备背景复杂以及单一图像信息量的局限性。针对这一问题,该文提出了一种基于多模态图像融合的变电设备红外热像增强识别方法。首先,采集包含避雷器、断路器、互感器等五类设备的红外和可见光图像,涵盖110、220、500 kV等多个电压等级;然后,通过深度卷积神经网络建立无监督范式的图像融合模型,将红外和可见光图像进行有效融合;最后,改进YOLOv7的特征提取网络以更好地从融合图像中识别变电设备。实验结果表明,变电设备的识别平均精度达到94.82%,显示出该方法优异的准确性,可为实现变电设备状态精细化检测提供支撑。

关键词:变电设备 图像融合 自动识别 深度学习

变电设备的热故障监测对保障电力系统的安全稳定运行至关重要[1-3]。随着电网数字化进程的推进,运维人员采用多种手段进行设备巡检,包括固定式镜头以及搭载红外成像仪的巡检机器人和无人机等[4-6]。这些手段有效地减轻了人工巡检过程中数据采集的工作量,但在处理海量红外图像时,仍采用人工分析的方法,导致效率低且准确率有限[7-9]。因此,亟须研究红外图像中变电设备的自动识别方法,提高巡检效率和准确率。

然而,复杂的环境背景以及红外图像信息量的局限性是影响变电设备自动识别性能的关键因 素[10-11]。由于变电设备与周围环境的温差较小,且红外成像易受环境噪声、大气衰减等因素干扰[12-13],变电设备与环境背景难以有效分割,严重影响了识别的准确率。图像融合技术能够从不同图像中提取显著特征,并将这些特征融合为一张图像,使得融合后的图像在信息丰富性和表现力上明显优于单一图像[14-16]。因此,红外和可见光图像的融合能更全面、准确地反映变电设备信息,从而有助于提高自动识别准确率。

近五年来,基于自编码器、卷积神经网络(Convolutional Neural Network, CNN)和生成对抗网络的图像融合方法得到了广泛研究。文献[17]提出了图像融合方法DenseFuse,该方法通过卷积、融合策略和密集块对图像进行编码,然后利用解码器重建图像以生成融合结果。文献[18]提出了双判别条件生成对抗图像融合(Dual-Discriminator conditional Generative Adversarial Network, DDcGAN)方法,该方法通过对抗训练融合了不同分辨率的红外与可见光特征,同时保持了红外图像的热辐射与可见光图像的纹理细节。文献[19]提出了图像融合卷积神经网络(Image Fusion Convolutional Neural Network, IFCNN),该方法通过端到端的方式提取和融合了多张图像的特征,使融合图像具有更好的泛化能力和融合质量。文献[20]提出了变分自编码器图像融合(Variational Auto-Encoder Fusion, VAEFuse)方法,通过生成潜在向量,有效地融合了红外和可见光图像中的纹理、轮廓及热特征。文献[21]提出了基于聚合残差变换与密集连接的融合网络(Residual X Dense Network Fusion, RXDNFuse),通过结合聚合残差变换网络(Residual Network X Transformation, ResNeXt)和DenseNet的结构优势,使融合图像能够自动保留不同维度的信息从而提高图像细节质量。虽然上述方法在提升融合效果方面表现较好,但也存在各自的局限性。例如,DenseFuse采用固定的融合策略,在亮度差异较大的区域会有显著的细节丢失;DDcGAN在对抗训练过程中容易崩溃,消耗大量计算资源,并且在融合过程中,边缘特征区域可能会过度平滑,造成细节信息的丢失;IFCNN采用固定的融合策略,在融合过程中,对比度差异大的区域会出现明显模糊;VAEFuse通过Kullback- Leibler(KL)散度使编码后的特征服从特定分布,在细节特征分布较集中的区域会造成明显的伪影;RXDNFuse依赖密集网络,在融合过程中可能会增强噪声,造成红外高亮区域的对比度降低。

随着目标检测领域的快速发展,相关研究人员将变电设备与目标检测相结合更好地支撑状态评估。文献[22]提出了基于快速区域的卷积神经网络(Faster Region-based CNN, Faster R-CNN)的电流互感器红外图像识别方法,该方法通过旋转目标提高了设备识别的准确率。文献[23]提出了基于轻量化掩码区域的卷积神经网络(Mask Region-based CNN, Mask R-CNN)的开关设备识别方法,通过轻量化模型提高了在实际应用中识别的可部署性和效率。文献[24]提出了基于双通道卷积神经网络的电力设备识别方法,通过两个独立的卷积神经网络模型提高了特征提取的效果,从而提高了识别准确率。文献[25]提出了基于图像增强与深度学习的变电设备红外热像识别方法,通过图像增强方法改善图像对比度、信噪比等特征,提供更多的特征信息用于后续分析,从而提高了识别准确率。文献[26]提出基于改进YOLOv3的电力设备红外目标检测方法,通过在YOLOv3模型中引入跨阶段局部模块提高电力设备识别的准确率。上述方法在提升电力设备识别准确率和效率方面取得了显著成果,然而也存在各自的局限性。文献[22]未考虑不同设备及复杂场景对目标识别的干扰,相似设备或变换不同场景可能导致识别准确率不佳;文献[23]未考虑轻量化对模型泛化性的影响,变换场景可能因模型量化能力不足导致准确率不佳;文献[24]未考虑神经网络参数与分析效率的关系,且参数的增加会导致模型泛化能力降低,无法满足实时性的要求;文献[25]未考虑图像增强过程中噪声的影响,容易造成差异显著区域中特征信息的弱化,且单一图像信息的局限性难以适应不同场景;文献[26]未考虑图像质量的影响,且识别过程完全依赖特征提取,导致在复杂环境下的识别效果会受到噪声等因素影响。

针对上述问题,本文提出了一种基于多模态图像融合的变电设备红外热像增强识别方法。首先,建立无监督范式的多模态图像融合方法,通过改进图像融合框架,将特征融合引入每个环节中,借助深度卷积神经网络的非线性拟合,提高特征融合的自适应能力,并且引入多维度跨连机制提高特征的流动性和利用效率,从而实现红外和可见光图像的有效融合,以获取更全面、更精确的场景信息;然后,改进YOLOv7的特征提取网络,通过特征保留策略,减少特征提取过程中小目标、低对比度等细节信息的丢失,同时引入特征跨连机制,增强浅层和深层特征之间的信息传递,提高多模态特征的利用效率,从而提高变电设备识别准确率;最后,通过大量的实验分析验证变电设备红外热像增强识别方法的准确性和有效性。

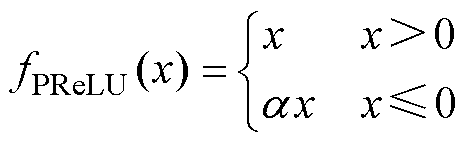

在计算机视觉领域,图像融合包括三个环节:特征提取、特征融合和图像重构,它们通常以串联方式依次发挥作用。特征提取是从原始数据中挖掘有效信息的过程;特征融合是将不同来源、类型或尺度的特征进行整合的过程;图像重构则是通过部分图像数据恢复出完整且清晰图像的过程。

传统图像融合框架与本文所提框架的对比如图1所示。本文核心改进点是特征融合的自适应,通过将特征融合引入每个环节中,并借助深度卷积神经网络的非线性拟合,提高特征融合在面对复杂任务时的自适应能力。

图1 融合方法框架对比

Fig.1 Comparison of fusion method frameworks

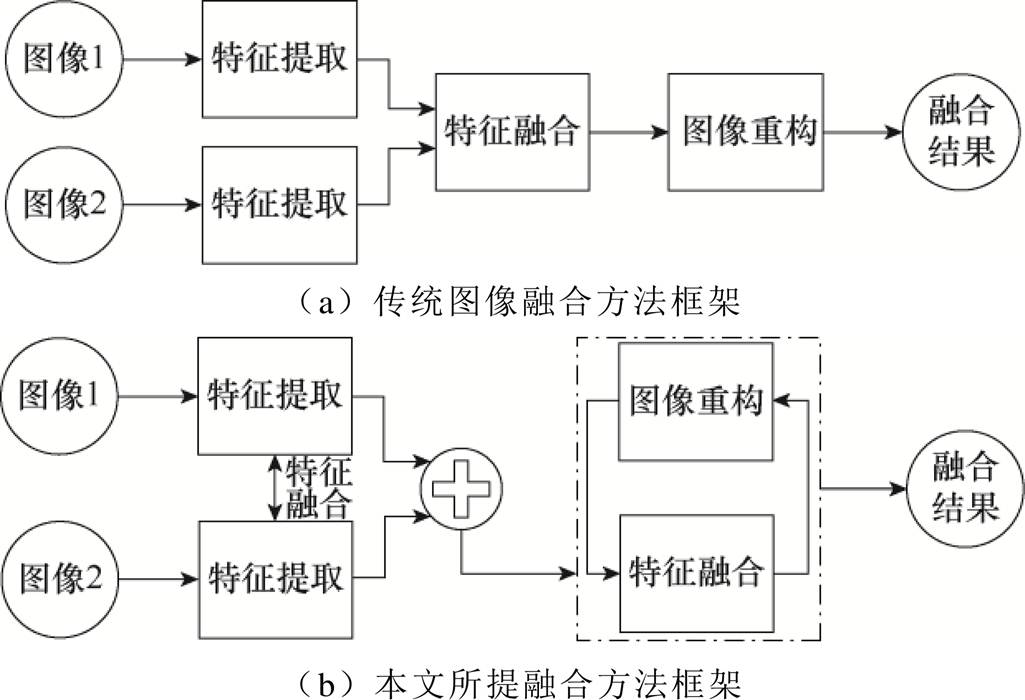

为了充分挖掘图像中不同通道之间的关联信息,将红外和可见光图像以RGB格式输入,并对每个通道分开计算。多模态融合网络结构如图2所示。

图2 多模态融合网络结构

Fig.2 Multi-modal fusion network structure

参考VGG16网络的设计思路,特征提取网络设计为5次连续的计算组。通过这种方式,获得了5个维度的特征,将其分别称为:最高维度特征、高维度特征、中间维度特征、低维度特征、最低维度特征。为了减轻网络训练过程中梯度消失和性能退化所带来的不利影响,同时提高不同维度特征的流动性和利用效率,对于只存在间接联系的特征,通过跳跃连接建立直接联系,即建立最高维度特征与中间维度特征的直接联系,以及建立中间维度特征与最低维度特征的直接联系。

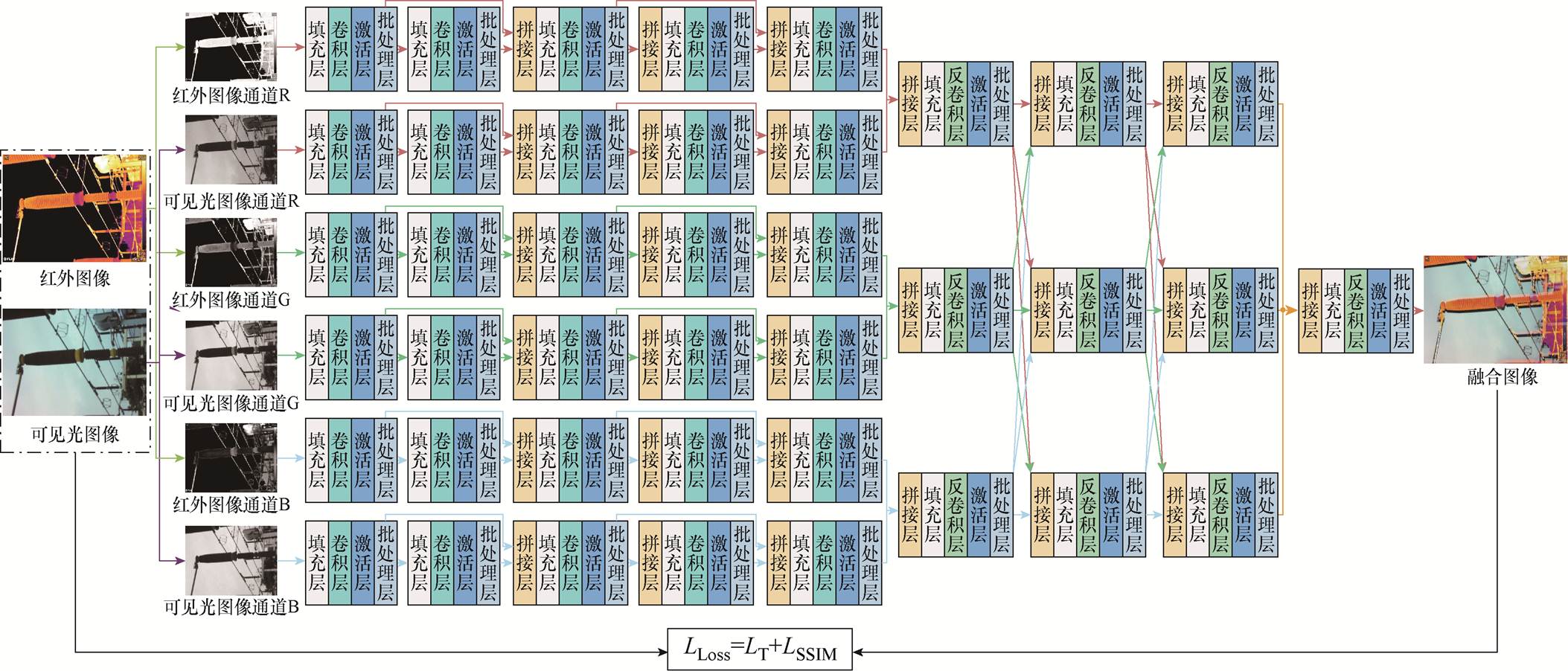

特征提取过程中往往通过池化等策略减小特征图的尺寸,从而降低计算复杂度。然而池化策略只保留区域内最显著的特征,这会造成非显著特征的丢失,如边缘、纹理特征等。本文通过卷积代替池化策略进行计算,用于减少特征的丢失,采用(3, 3)的卷积核,步长设置为(2, 2),其计算示例如图3所示。

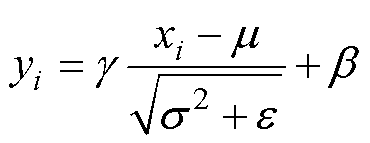

图3展示了二维卷积的计算示例,其数学的核心原理是通过局部加权来提取特征,并采用PReLU激活函数对卷积提取的特征进行处理,通过非线性化表示提高对复杂模式的学习和表述能力。PReLU激活函数的计算公式为

图3 二维卷积计算示例

Fig.3 Example of 2D convolutional calculation

(1)

(1)

式中,x为输入特征;a为可学习的参数,随着模型损失值而更新,取值范围为0~1。此处通过参数a使模型能够根据数据的分布情况自适应调整,如输入特征可能存在始终为负的情况。然后通过批处理对数据进行归一化处理,提高模型训练过程的稳定性。批处理的计算公式为

(2)

(2)

式中,xi为输入的第i个特征数据;m和s2分别为特征数据x的均值和方差;e为一个常数,设为e=10-5;g和b为可学习的参数,随着模型损失值而动态调整。

特征融合和图像重构两个环节交叉进行,首先将特征提取环节获得的不同图像中相同通道的特征进行融合;然后通过反卷积、激活函数及批处理计算对特征进行上采样,实现特征尺寸的恢复;最后通过连续3次的特征融合、图像重构计算,获得重构图像,同时考虑到损失函数计算的需求,将重构图像与输入图像尺寸进行匹配,以减小计算复杂度。

为了使融合结果能够充分有效地学习变电设备红外和可见光图像的内在结构及模态特征,本文结合电力行业的先验知识,从温度特征和图像信息损失两个维度设计损失函数。

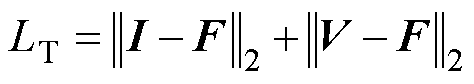

考虑到红外图像能够反映变电设备表面的温度信息,且温度分布与像素分布之间存在非线性关系,即像素分布可以近似等效温度分布。本文将像素差定义为温度分布特征的差值,以此建立温度特征损失LT,表示为

(3)

(3)

式中,I、V和F分别为红外、可见光和融合图像; 表示L2范数。

表示L2范数。

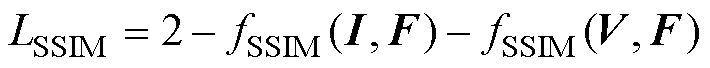

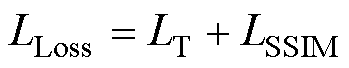

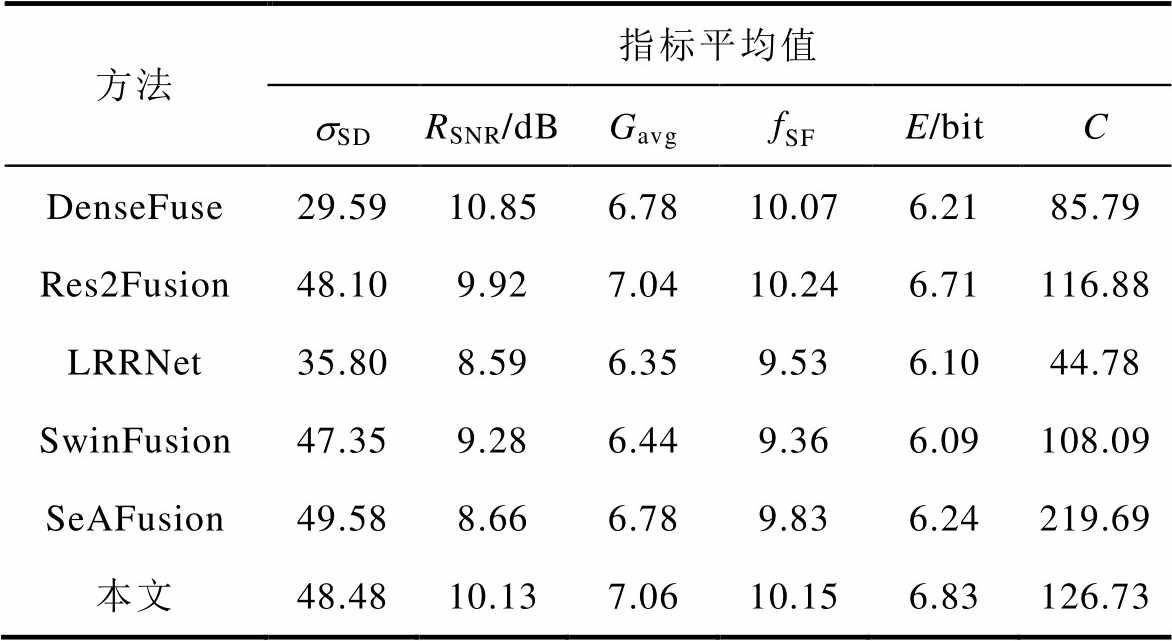

通过结合对比度和细节纹理两个维度对图像信息损失LSSIM进行计算,其计算式为

(4)

(4)

其中

(5)

(5)

式中,X、Y分别为两幅不同的图像;mX、mY分别为两幅图像的均值; 、

、 分别为两幅图像的方差;sXY为两幅图像的协方差;C1和C2为常数,分别设置为6.5和58.52,用于避免分母为零带来的影响,同时提高特征的平滑性。

分别为两幅图像的方差;sXY为两幅图像的协方差;C1和C2为常数,分别设置为6.5和58.52,用于避免分母为零带来的影响,同时提高特征的平滑性。

最后,通过加权将温度特征和图像信息损失组合为损失计算函数,其计算式为

(6)

(6)

在巡检过程中,由于图像采集距离、角度以及设备本身尺寸的差异,会导致不同图像中相同变电设备所包含的特征存在差异,这将会影响特征提取的效果,从而影响变电设备识别的准确率。为了减轻上述因素带来的不良影响,本文将改进YOLOv7的特征提取网络,以更有效地利用图像融合结果中的显著特征。改进的YOLOv7特征提取网络如图4所示。

图4 改进的特征提取网络

Fig.4 Improved feature extraction network

YOLOv7的特征提取网络通过ELAN(efficient layer aggregation network)结构结合多尺度特征融合,将尺寸为(640, 480, 3)的输入数据提取为三种维度特征(80, 60, 512)、(40, 30, 1 024)、(20, 15, 1 024)[27]。基于此,本文将改进网络,以提高特征的利用效率。改进的YOLOv7特征提取网络的核心点体现在以下两个方面:

1)保留更多的细节信息。由于池化只保留区域内最显著的特征,会造成非显著的特征丢失,通过卷积学习权重提取特征,可以使不同尺度的特征都能得到充分学习和表示,从而保留边缘、纹理等信息。

2)提高特征的利用效率。为了避免特征信息在传递过程中丢失或变形,通过跳跃连接在ELAN模块上构建不同维度特征的联系,从而实现多维度特征的深度融合与高效计算。

YOLOv7目标检测模型的输出是图像中不同变电设备可能所在的区域,然后通过非极大值抑制的后处理方法进行筛选,最后只保留最合适的区域结果。以110 kV断路器为例,其识别的步骤如下:

1)将110 kV断路器的红外和可见光图像大小调整为融合模型所需大小,此处为640×480,并将图像数据范围进行归一化处理,调整为[0, 1]。

2)将处理后的红外和可见光图像输入融合模型,计算图像融合结果。

3)将图像融合结果输入改进的YOLOv7模型,计算变电设备预测结果。

4)根据预测结果,通过非极大值抑制方法进行处理,并将结果通过Python图像处理库进行显示或保存。

综上所述,变电设备首先通过图像融合模型进行特征增强,然后再基于改进的YOLOv7模型对设备类型进行识别。

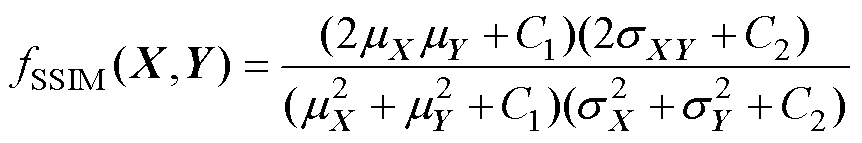

3.1.1 数据集构建

本文首先使用FLIR T640成像仪在重庆、深圳等地的变电站采集了红外和可见光图像,包括断路器、避雷器、互感器、绝缘子等设备,然后通过人工筛选、配准构建了包含11 034张图像的数据集。考虑到不同电压等级的同一类型设备在外观及尺寸上存在差异,为了更好地开展变电设备识别实验,将数据集中的设备图像按110、220、500 kV三个电压等级进一步细分。

表1列出了不同电压等级、类型的设备图像数量分布,总计包含11 034张图像,其中红外和可见光图像各5 517张。考虑到模型训练的需要,将数据集中图像的分辨率统一设置为640×480,并按照81 9

9 10的比例将数据集划分为训练集、验证集和测试集。具体而言,训练集中包含4 468对红外与可见光图像,验证集中包含496对图像,测试集中包含553对图像。

10的比例将数据集划分为训练集、验证集和测试集。具体而言,训练集中包含4 468对红外与可见光图像,验证集中包含496对图像,测试集中包含553对图像。

表1 数据集组成

Tab.1 Dataset composition

设备类型电压等级/kV红外图像/张可见光图像/张 断路器110516516 220417417 避雷器110522522 220627627 电流互感器110828828 220771771 电压互感器110348348 220399399 500243243 绝缘子110312312 220474474 5006060 总计5 5175 517

3.1.2 实验设置

模型训练是在硬件配置为Intel Xeon-6226R的CPU和带有16 GB的NVIDIA Tesla V100的GPU上进行的,模型网络通过2.10版本的TensorFlow构建。模型的输入图像尺寸为640×480,学习率为1×10-5,批次大小为16,优化器选择Adam。数据增强选择Mosaic方法,参数设置为0.5,通过在训练过程中随机拼接4张不同的图像来增强模型对不同场景和尺度的适应能力,从而提高模型的泛化能力。模型权重的更新通过前向和反向传播进行,训练结束后,将自动保存训练好的神经网络参数。

本文所提出的图像融合模型总共进行了300个世纪的训练(世纪是指模型遍历一次所有训练数据的过程),最终模型训练集损失值收敛在0.422,验证集损失值收敛在0.423。将训练好的模型在测试集图像上测试,融合结果如图5所示。

图5展示了变电设备的红外和可见光图像融合结果,从主观视觉角度分析可以看出,融合后的图像明显优于单一图像,具体体现在以下几个方面。

1)细节增强:融合图像能够更好地展示设备所处环境的细节及轮廓。

2)信息互补:融合图像能够结合红外图像的温度信息和可见光图像的结构信息,提供更全面的设备状态表现。

图5 复杂环境下的图像融合结果

Fig.5 Image fusion result in complex backgrounds

3)视觉清晰度:融合后的图像在视觉上更加清晰、易于分辨,避免了单一图像在特定条件下(如光照或温度变化)可能出现的模糊或不完整的情况。

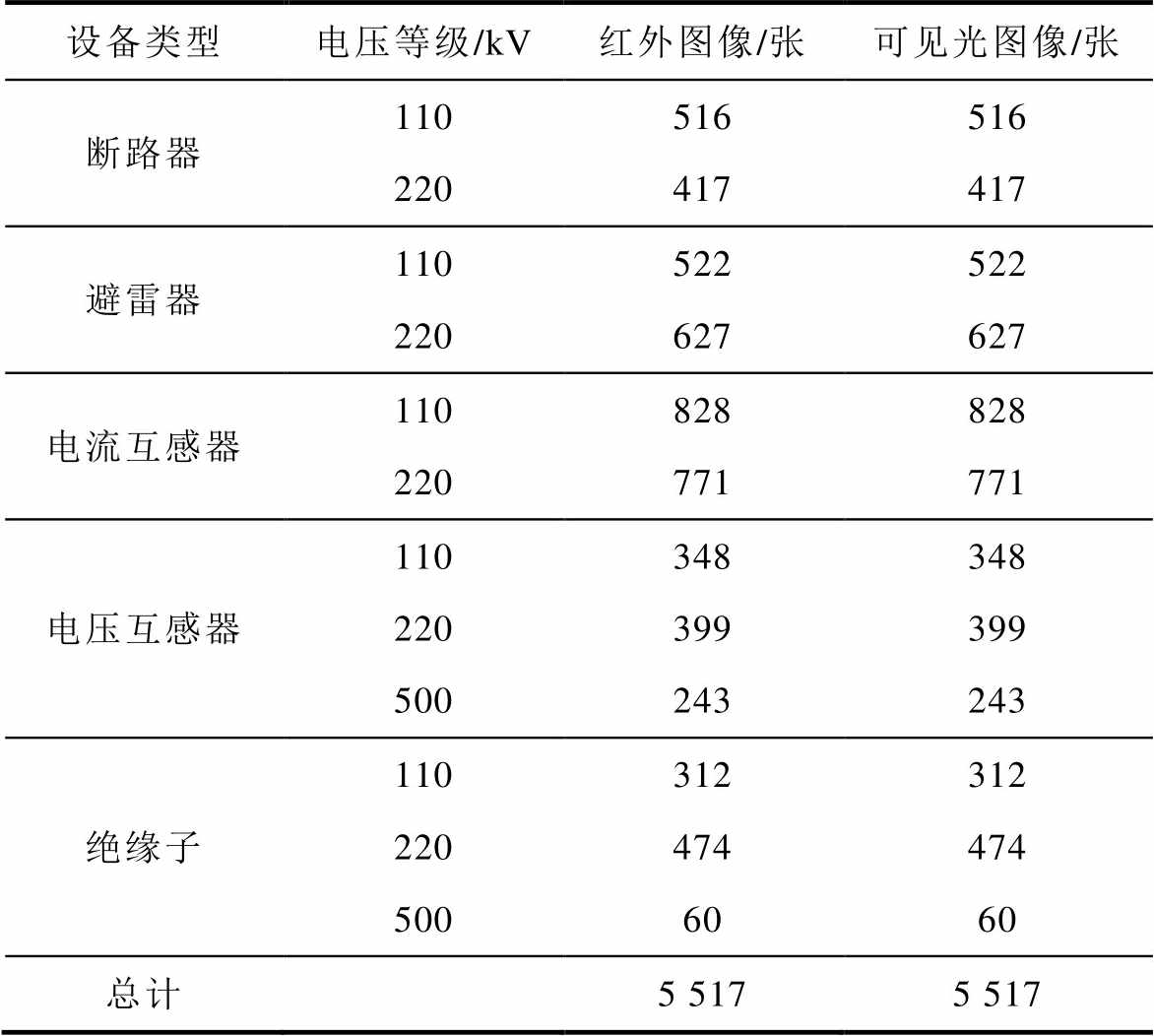

为了进一步定量评价图像融合的效果,通过标准差sSD、信噪比RSNR、平均梯度Gavg、空间频率fSF、信息熵E和对比度C共6个指标与DenseFuse[17]、Res2Fusion[28]、LRRNet[29]、SwinFusion[30]、SeAFusion[31]等方法进行对比,结果见表2。

表2 不同融合方法对比结果

Tab.2 Comparison results of different fusion methods

方法指标平均值 sSDRSNR/dBGavgfSFE/bitC DenseFuse29.5910.856.7810.076.2185.79 Res2Fusion48.109.927.0410.246.71116.88 LRRNet35.808.596.359.536.1044.78 SwinFusion47.359.286.449.366.09108.09 SeAFusion49.588.666.789.836.24219.69 本文48.4810.137.0610.156.83126.73

一般情况下,评价指标的值越大越好。由表2可知,本方法的6个指标分别为48.48、10.13 dB、7.06、10.15、6.83 bit、126.73,与DenseFuse、Res2Fusion相比,具有5个指标的领先优势;与LRRNet、SwinFusion相比,6个指标均有领先优势;与SeAFusion相比,具有4个指标的领先优势。综上所述,通过对比发现,本文方法在超过一半的指标上具有领先优势,进一步验证了本文所提融合方法的优势。

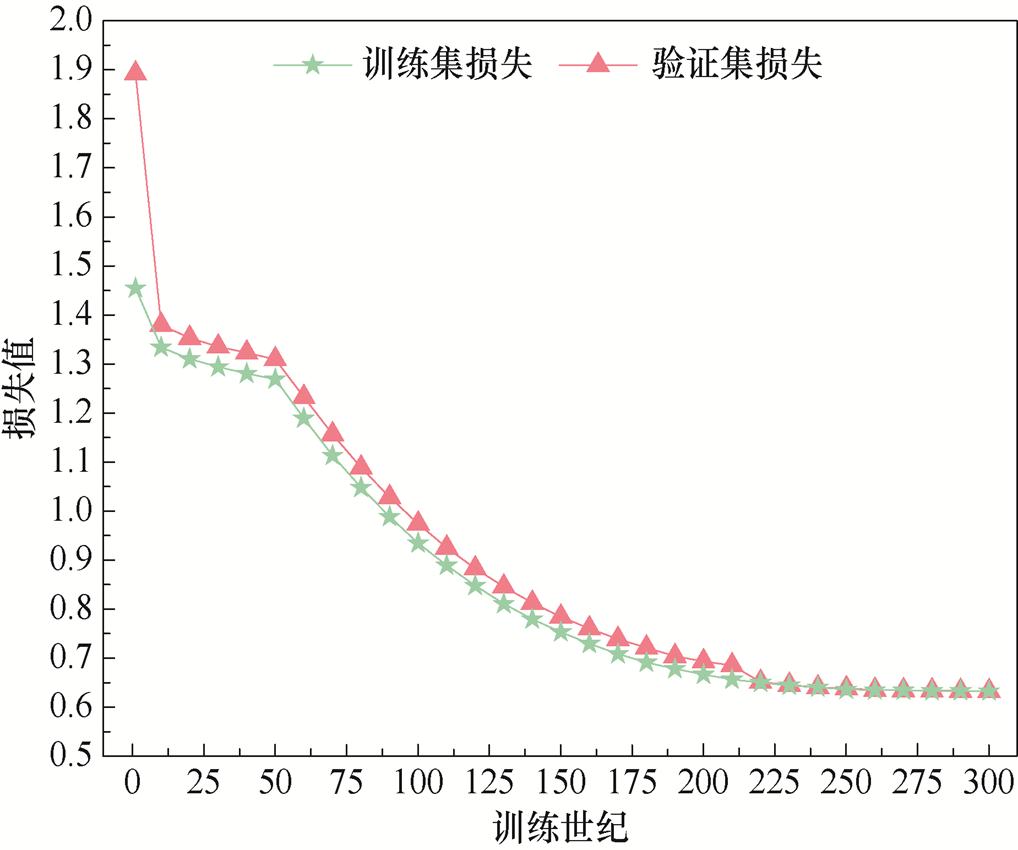

3.3.1 数据集训练收敛性分析

在训练改进的YOLOv7模型之前通过图像融合模型的5 517张融合结果来构建数据集,训练集、验证集和测试集的比例也设置为81 9

9 10,即训练集4 468张图像,验证集496张图像,测试集553张图像。改进的YOLOv7模型共进行300个世纪的训练,得到模型损失值变化如图6所示。由图6可知,训练过程中,损失值随着训练的进行逐渐减小,这表明模型参数不断地被正向优化,最终模型在训练集上的损失为0.632 9,验证集上损失为0.632 6。

10,即训练集4 468张图像,验证集496张图像,测试集553张图像。改进的YOLOv7模型共进行300个世纪的训练,得到模型损失值变化如图6所示。由图6可知,训练过程中,损失值随着训练的进行逐渐减小,这表明模型参数不断地被正向优化,最终模型在训练集上的损失为0.632 9,验证集上损失为0.632 6。

图6 模型损失值变化

Fig.6 Loss value change of model

3.3.2 数据集识别结果分析

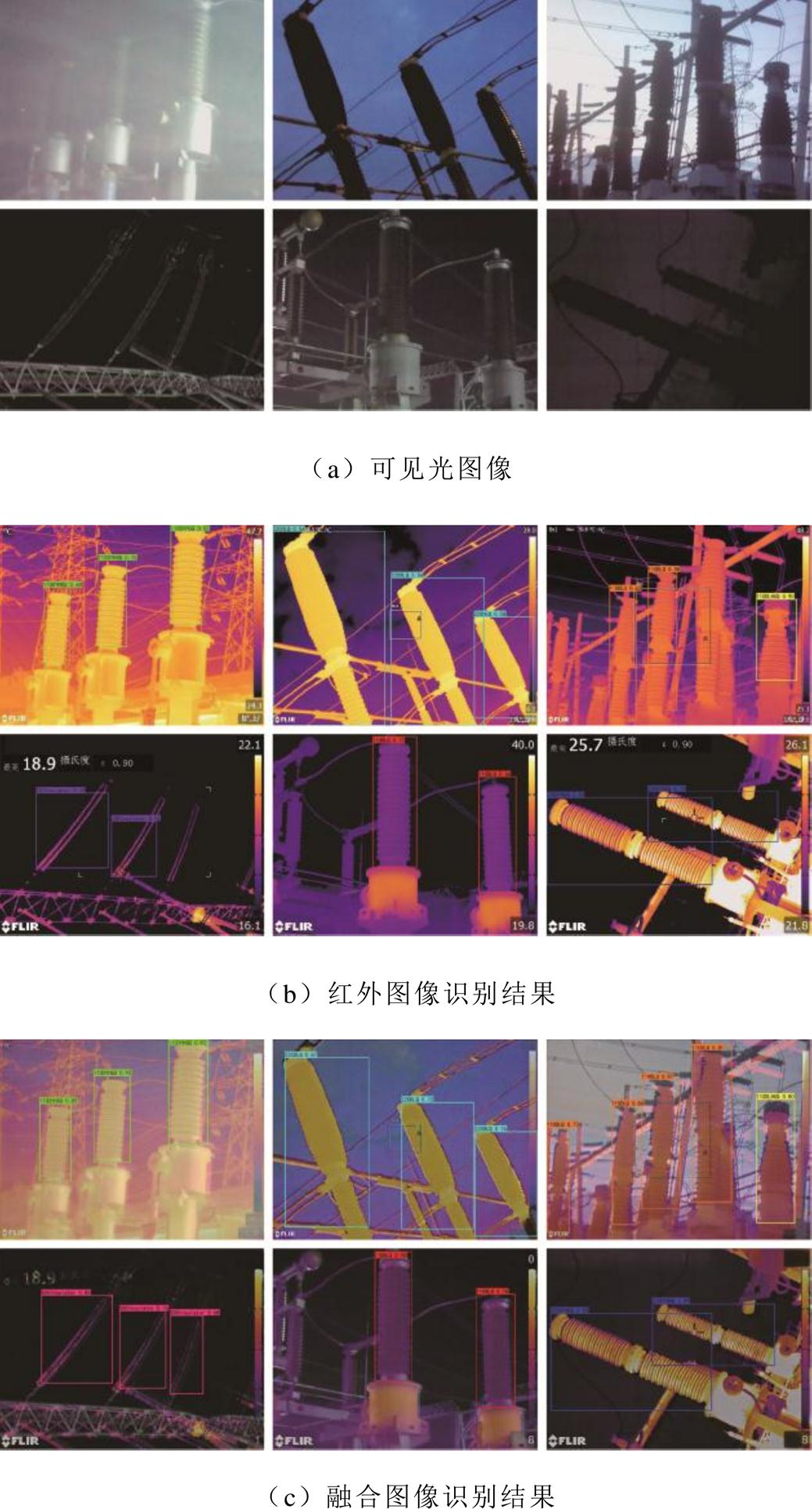

通过本文改进的YOLOv7模型在测试集553张图像上进行测试,为了与图像融合的结果有效对应,选取图5中的复杂环境融合结果进行展示,其变电设备识别结果如图7所示。

图7 复杂背景下变电设备识别结果

Fig.7 Identification results of substation equipment in complex backgrounds

图7a是用红外图像作为数据集训练出的模型,并在测试集上得出的识别结果;图7b是用融合图像作为数据集训练出的模型,并在测试集上得出的识别结果。由图7可以明显看出,本文所研究的几种变电设备在融合图像中均能被准确检测,其识别效果显著优于红外图像中的检测结果。这种优势体现在更高的识别准确率和置信度上,进一步验证了图像融合在提升变电设备目标检测性能方面的有 效性。

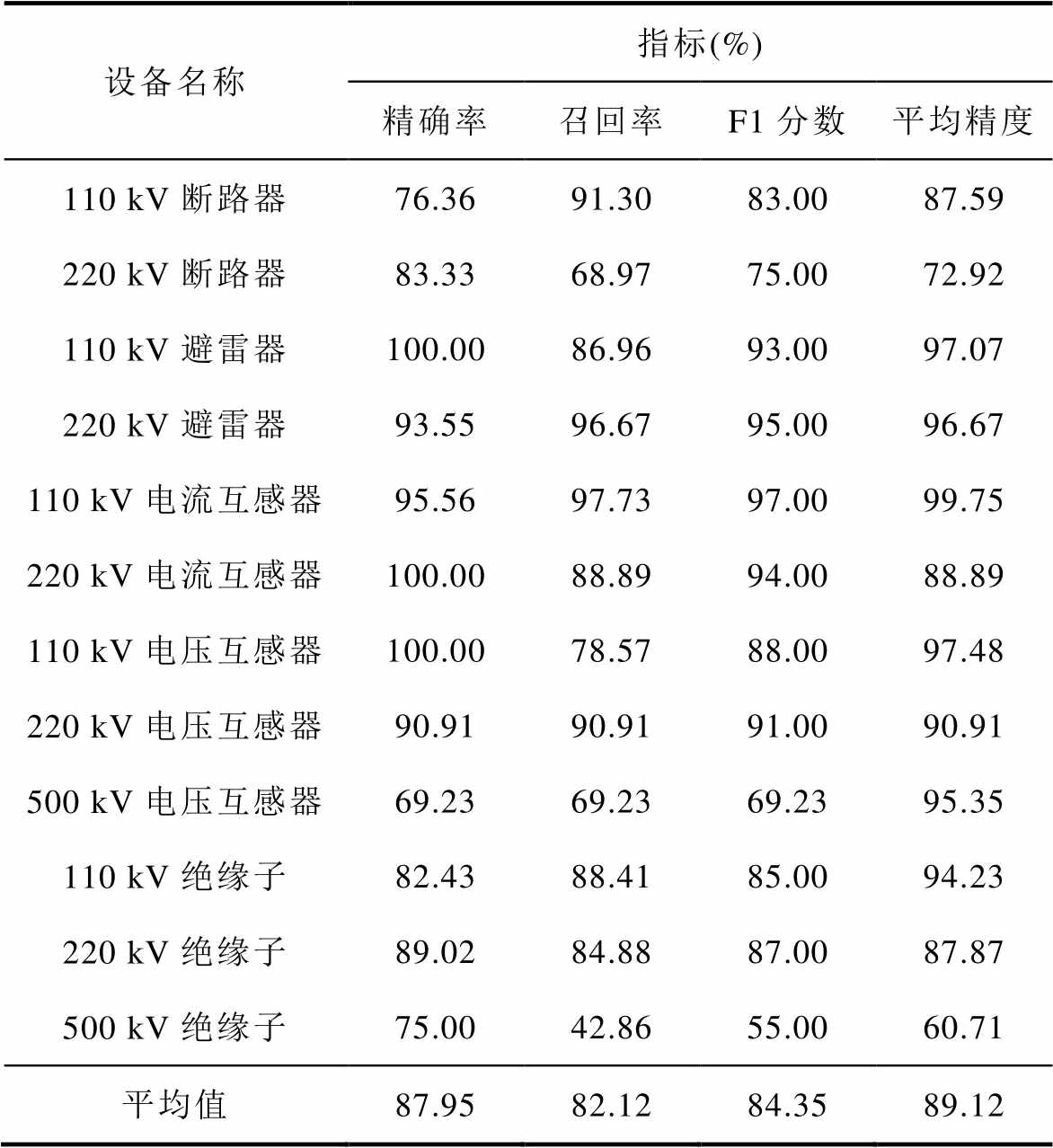

为了进一步定量分析图像融合对变电设备识别的作用,通过平均精度、精确率、召回率和F1分数等指标进行分析,其中平均精度指的是不同召回率下对应精确率的平均值。红外图像上的指标分析结果见表3。

表3 红外图像识别结果分析

Tab.3 Analysis of infrared image identification results

设备名称指标(%) 精确率召回率F1分数平均精度 110 kV断路器76.3691.3083.0087.59 220 kV断路器83.3368.9775.0072.92 110 kV避雷器100.0086.9693.0097.07 220 kV避雷器93.5596.6795.0096.67 110 kV电流互感器95.5697.7397.0099.75 220 kV电流互感器100.0088.8994.0088.89 110 kV电压互感器100.0078.5788.0097.48 220 kV电压互感器90.9190.9191.0090.91 500 kV电压互感器69.2369.2369.2395.35 110 kV绝缘子82.4388.4185.0094.23 220 kV绝缘子89.0284.8887.0087.87 500 kV绝缘子75.0042.8655.0060.71 平均值87.9582.1284.3589.12

由表3可知,整体平均精确率为87.95%,平均召回率为82.12%,平均F1分数为84.35%,平均精度为89.12%。不同电压等级的设备识别性能存在明显差异,其中110 kV、220 kV断路器以及220 kV、500 kV绝缘子等设备的识别性能较差,而避雷器、电压互感器的识别性能相对较好。通过分析发现,110 kV断路器和220 kV断路器在图像对比度较低的情况下,容易出现相互误识别的情况,其原因是断路器通常是ABC三相一起拍摄的,拍摄中可能会出现某一个断路器只有一半甚至不到一半信息的情况,且110 kV和220 kV断路器外形差异较小。由于绝缘子等设备体积相对较小,对应的特征信息也较少,因此容易出现漏检的情况,这也是小目标检测一直以来需要解决的难题。110 kV避雷器和220 kV避雷器外观尺寸差异非常明显,误识别的情况较少;互感器等设备通常体积较大,特征明显。表4展示了融合图像上的指标分析结果。

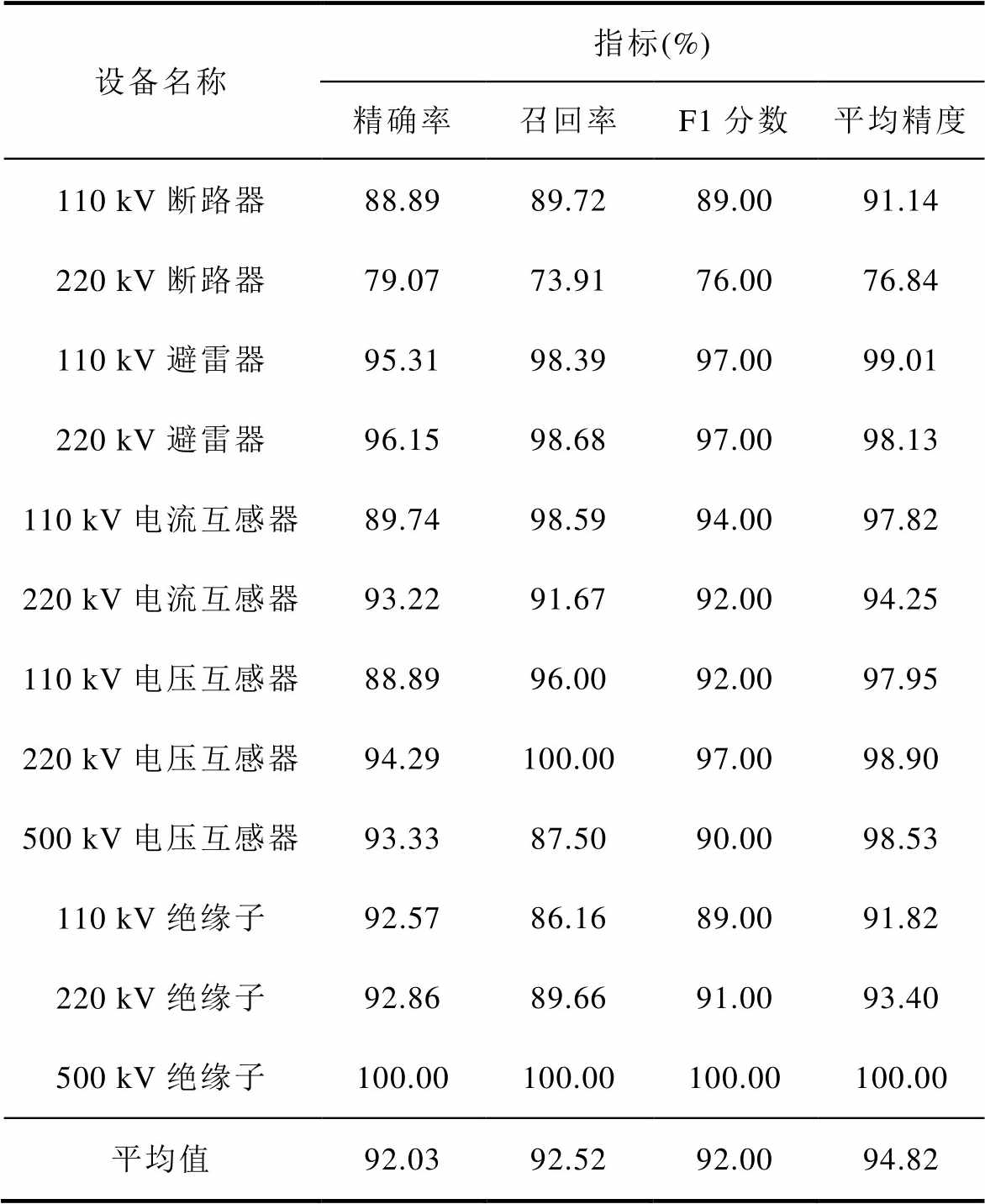

表4 融合图像识别结果分析

Tab.4 Analysis of fusion image identification results

设备名称指标(%) 精确率召回率F1分数平均精度 110 kV断路器88.8989.7289.0091.14 220 kV断路器79.0773.9176.0076.84 110 kV避雷器95.3198.3997.0099.01 220 kV避雷器96.1598.6897.0098.13 110 kV电流互感器89.7498.5994.0097.82 220 kV电流互感器93.2291.6792.0094.25 110 kV电压互感器88.8996.0092.0097.95 220 kV电压互感器94.29100.0097.0098.90 500 kV电压互感器93.3387.5090.0098.53 110 kV绝缘子92.5786.1689.0091.82 220 kV绝缘子92.8689.6691.0093.40 500 kV绝缘子100.00100.00100.00100.00 平均值92.0392.5292.0094.82

由表4可知,12种变电设备的平均精确率、平均召回率、平均F1分数和平均精度分别为92.03%、92.52%、92.00%和94.82%,相比于表3的结果,其平均精确率提高了4.08个百分点,平均召回率提高了10.40个百分点、平均F1分数提高了7.65个百分点、平均精度提高了5.70个百分点,且图像融合使红外图像中识别性能较差的设备识别性能也得到了不同程度的提升,同时对由于外形相似所导致的变电设备误识别问题,也得到了有效缓解,这个结果进一步验证了图像融合对于提高变电设备检测性能的显著优势。

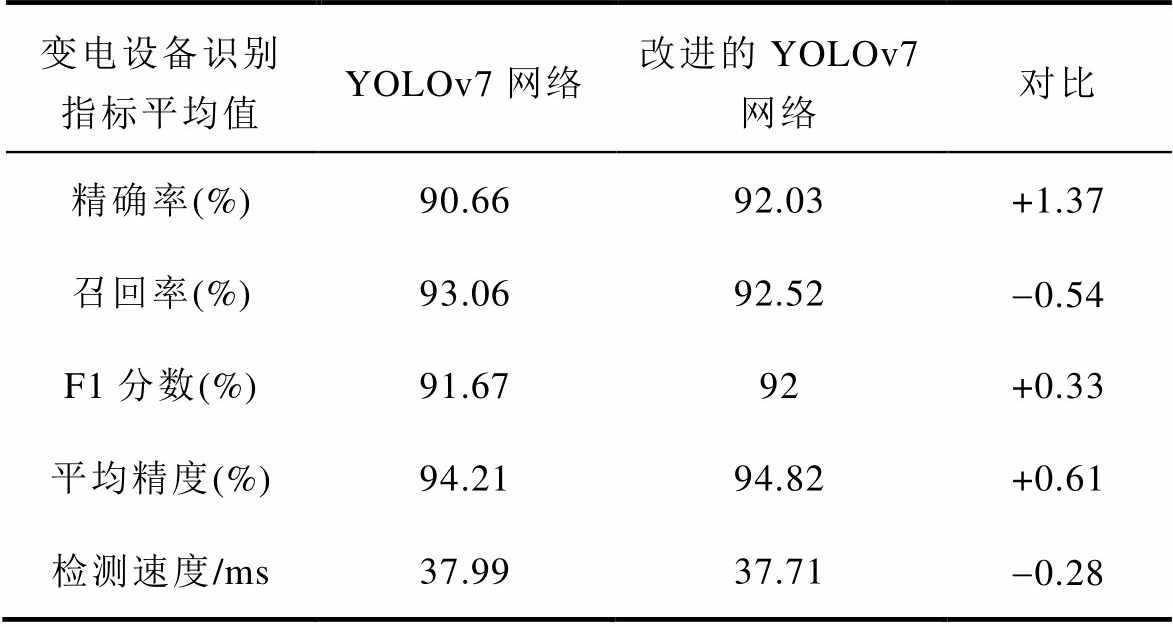

为了进一步说明本文改进YOLOv7网络的优越性,将YOLOv7改进前后的网络在相同条件、相同设置下通过12种变电设备的平均精确率、召回率、F1分数、平均精度和检测速度等指标进行对比,其结果见表5。

表5 YOLOv7识别结果分析

Tab.5 Analysis of YOLOv7 identification results

变电设备识别指标平均值YOLOv7网络改进的YOLOv7网络对比 精确率(%)90.6692.03+1.37 召回率(%)93.0692.52-0.54 F1分数(%)91.6792+0.33 平均精度(%)94.2194.82+0.61 检测速度/ms37.9937.71-0.28

通过表5可以看出,与YOLOv7网络相比,改进后的YOLOv7网络在指标上明显具有优势,其中平均精确率提高了1.37个百分点,平均F1分数提高了0.33个百分点,平均精度提高了0.61个百分点,平均检测速度提高了0.28 ms,而平均召回率降低了0.54个百分点,这个情况是正常的,一般情况下,精度和召回率之间存在一种权衡关系,即精度提高的过程中召回率会有所下降。综上所述,分析结果表明,改进后的YOLOv7网络在识别变电设备融合图像上具有更显著的优势。

为了进一步分析模型在不同光照、天气等环境因素影响下的识别性能,额外收集了部分图像并开展相关实验,得到环境因素对识别性能的影响分析如图8所示。

图8 环境因素对识别性能的影响分析

Fig.8 Analysis of the influence of environmental factors on recognition performance

由图8可知,测试图像间的亮度变化主要源于外部光照差异,这为光照条件变化下的模型鲁棒性分析提供了验证数据基础。为进一步量化天气等环境因素的影响,以拍摄时间及环境温度信息为特征列出图8中图像的差异,以图8a中从左到右、从上到下的顺序列举。第一张图像拍摄于7月26日,环境温度约为38℃;第二张图像拍摄于5月17日,环境温度约为25℃;第三张图像拍摄于8月2日,环境温度约为32℃;第四张图像拍摄于5月10日,环境温度约为20℃;第五张图像拍摄于7月3日,环境温度约为22℃;第六张图像拍摄于5月20日,环境温度约为23℃,这些图像拍摄时间分布于5—8月,环境温度波动范围为20~38℃。通过上述受亮度、天气等环境因素显著影响的图像进行鲁棒性 分析。

通过对比分析图8b与图8c的识别结果可以发现,即使受光照、天气等环境因素影响,本文所研究的变电设备在融合图像中均能被准确检测,且识别的准确率和置信度明显优于红外图像。这个结果验证了本文所提出方法的优势及鲁棒性,也进一步验证了图像融合对提高变电设备检测性能的显著 优势。

本文提出了一种基于多模态图像融合的变电设备红外热像增强识别方法。首先,通过无监督范式的图像融合模型,可以有效地融合红外和可见光图像中的显著特征,在信息熵等四个指标上相比主流方法存在显著优势;其次,通过融合图像进行变电设备识别,有效地提高了检测性能,其中平均精确率提高了4.08个百分点,平均召回率提高了10.40个百分点、平均F1分数提高了7.65个百分点、平均精度提高了5.70个百分点,有效地验证了图像融合对变电设备检测的提升效果;然后,与原YOLOv7网络相比,进一步说明了改进后YOLOv7网络在变电设备识别的优势,其中平均精度提高了0.61个百分点,检测速度提高了0.28 ms;最后,分析了不同光照、天气等环境因素影响下的识别性能,进一步验证了本文所提出方法的鲁棒性。

基于上述变电设备识别方法,下一步将通过融合图像研究多特征参量的变电设备热故障检测方法,以提高故障检测效率,为变电设备的安全稳定运行提供支撑。

参考文献

[1] 肖懿, 罗丹, 蒋沁知, 等. 基于温度概率密度的变电站高压设备故障热红外图像识别方法[J]. 高电压技术, 2022, 48(1): 307-318.

Xiao Yi, Luo Dan, Jiang Qinzhi, et al. Thermal infrared image recognition method for high voltage equipment failure in substation based on temperature probability density[J]. High Voltage Engineering, 2022, 48(1): 307-318.

[2] 杨帆, 王梦珺, 谭天, 等. 基于目标像素宽度识别的电力设备红外成像单目测距改进算法[J]. 电工技术学报, 2023, 38(8): 2244-2254.

Yang Fan, Wang Mengjun, Tan Tian, et al. An improved monocular ranging method for infrared image of power equipment based on the pixel width recognition of objects[J]. Transactions of China Electrotechnical Society, 2023, 38(8): 2244-2254.

[3] 刘云鹏, 王权, 刘一瑾, 等. 面向电力设备红外图像的混合噪声去除方法研究[J]. 高压电器, 2024, 60(3): 186-192.

Liu Yunpeng, Wang Quan, Liu Yijin, et al. Research on mixed noise removal method for infrared image of power equipment[J]. High Voltage Apparatus, 2024, 60(3): 186-192.

[4] 裴少通, 张行远, 胡晨龙, 等. 基于ER-YOLO算法的跨环境输电线路缺陷识别方法[J]. 电工技术学报, 2024, 39(9): 2825-2840.

Pei Shaotong, Zhang Hangyuan, Hu Chenlong, et al. The defect detection method for cross-environment power transmission line based on ER-YOLO algorithm [J]. Transactions of China Electrotechnical Society, 2024, 39(9): 2825-2840.

[5] 赵振兵, 冯烁, 席悦, 等. 大模型时代: 电力视觉技术新起点[J]. 高电压技术, 2024, 50(5): 1813- 1825.

Zhao Zhenbing, Feng Shuo, Xi Yue, et al. The era of large models: a new starting point for electric power vision technology[J]. High Voltage Engineering, 2024, 50(5): 1813-1825.

[6] 刘传洋, 吴一全. 基于红外图像的电力设备识别及发热故障诊断方法研究进展[J]. 中国电机工程学报, 2025, 45(6): 2171-2196.

Liu Chuanyang, Wu Yiquan. Research progress of power equipment identification and thermal fault diagnosis based on infrared images[J]. Proceedings of the CSEE, 2025, 45(6): 2171-2196.

[7] 叶俊, 邱志斌, 黄玉水, 等. 基于可见光与红外图像融合的变电设备轻量化检测算法[J]. 电气工程学报, 2025, 20(6): 30-41.

Ye Jun, Qiu Zhibin, Huang Yushui, et al. Lightweight detection algorithm for substation equipment based on visible and infrared image fusion[J]. Journal of Electrical Engineering, 2025, 20(6): 30-41.

[8] 余泊羲, 杨昊, 刘志业, 等. 基于主动红外热波技术的环氧复合材料内部裂纹缺陷检测可行性研究[J]. 绝缘材料, 2025, 58(11): 122-130.

Yu Boxi, Yang Hao, Liu Zhiye, et al. Feasibility study on internal crack defect detection in epoxy composites based on active infrared thermal wave technology[J]. Insulating Materials, 2025, 58(11): 122-130.

[9] 姜香菊, 王瑞彤, 马彦鸿. 基于轻量级改进RT- DETR边缘部署算法的绝缘子缺陷检测[J]. 电工技术学报, 2025, 40(3): 842-854.

Jiang Xiangju, Wang Ruitong, Ma Yanhong. Insulator defect detection based on lightweight improved RT- DETR edge deployment algorithm[J]. Transactions of China Electrotechnical Society, 2025, 40(3): 842-854.

[10] 刘传洋, 吴一全, 刘景景. 无人机航拍图像中绝缘子缺陷检测的深度学习方法研究进展[J]. 电工技术学报, 2025, 40(9): 2897-2916.

Liu Chuanyang, Wu Yiquan, Liu Jingjing. Research progress of deep learning methods for insulator defect detection in UAV based aerial images[J]. Trans- actions of China Electrotechnical Society, 2025, 40(9): 2897-2916.

[11] 仲林林, 刘柯妤. 面向电力巡检图像目标检测的联邦学习激励机制[J]. 电工技术学报, 2024, 39(17): 5434-5449.

Zhong Linlin, Liu Keyu. Federated-learning incentive mechanism for object detection in power inspection images[J]. Transactions of China Electrotechnical Society, 2024, 39(17): 5434-5449.

[12] 孙瑞筱, 胡玉耀, 蒋兴良, 等. 不同污秽影响下劣化瓷绝缘子发热规律与红外特征分析[J]. 电工技术学报, 2025, 40(11): 3591-3603.

Sun Ruixiao, Hu Yuyao, Jiang Xingliang, et al. Analysis of temperature rise and infrared feature of faulty porcelain insulators under different contamina- tion effects[J]. Transactions of China Electrotechnical Society, 2025, 40(11): 3591-3603.

[13] 裴少通, 马子儒, 刘云鹏, 等. 500 kV输电线路劣化瓷绝缘子非线性发热特性的红外分析[J]. 高压电器, 2024, 60(1): 33-40.

Pei Shaotong, Ma Ziru, Liu Yunpeng, et al. Infrared analysis of nonlinear heating characteristics of deteriorated porcelain insulator of 500 kV transmi- ssion lines[J]. High Voltage Apparatus, 2024, 60(1): 33-40.

[14] 冯旭刚, 阮善会, 王正兵, 等. 基于局部和全局特征的电力设备红外和可见光图像匹配方法[J]. 电工技术学报, 2025, 40(7): 2236-2246, 2305.

Feng Xugang, Ruan Shanhui, Wang Zhengbing, et al. Infrared and visible image matching method for power equipment based on local and global features [J]. Transactions of China Electrotechnical Society, 2025, 40(7): 2236-2246, 2305.

[15] Li Daoliang, Song Zhaoyang, Quan Chaoqun, et al. Recent advances in image fusion technology in agriculture[J]. Computers and Electronics in Agricul- ture, 2021, 191: 106491.

[16] Li Hui, Wu Xiaojun, Kittler J. MDLatLRR: a novel decomposition method for infrared and visible image fusion[J]. IEEE Transactions on Image Processing, 2020, 29: 4733-4746.

[17] Li Hui, Wu Xiaojun. DenseFuse: a fusion approach to infrared and visible images[J]. IEEE Transactions on Image Processing, 2019, 28(5): 2614-2623.

[18] Ma Jiayi, Xu Han, Jiang Junjun, et al. DDcGAN: a dual-discriminator conditional generative adversarial network for multi-resolution image fusion[J]. IEEE Transactions on Image Processing, 2020, 29: 4980- 4995.

[19] Zhang Yu, Liu Yu, Sun Peng, et al. IFCNN: a general image fusion framework based on convolutional neural network[J]. Information Fusion, 2020, 54: 99-118.

[20] Ren Long, Pan Zhibin, Cao Jianzhong, et al. Infrared and visible image fusion based on variational auto- encoder and infrared feature compensation[J]. Infrared Physics & Technology, 2021, 117: 103839.

[21] Long Yongzhi, Jia Haitao, Zhong Yida, et al. RXDNFuse: a aggregated residual dense network for infrared and visible image fusion[J]. Information Fusion, 2021, 69: 128-141.

[22] 李文璞, 毛颖科, 廖逍, 等. 基于旋转目标检测的变电设备红外图像电压致热型缺陷智能诊断方法[J]. 高电压技术, 2021, 47(9): 3246-3253.

Li Wenpu, Mao Yingke, Liao Xiao, et al. Intelligent diagnosis method of infrared image for substation equipment voltage type thermal defects based on rotating target detection[J]. High Voltage Engineering, 2021, 47(9): 3246-3253.

[23] 叶剑涛, 杨为, 柯艳国, 等. 基于红外图像实例分割的敞开式开关设备发热缺陷智能诊断方法[J]. 高压电器, 2021, 57(12): 201-208.

Ye Jiantao, Yang Wei, Ke Yanguo, et al. Intelligent diagnosis method for thermal defects of air insulated switchgear based on infrared image instance segmenta- tion[J]. High Voltage Apparatus, 2021, 57(12): 201- 208.

[24] Zhou Fangrong, Ma Yi, Wang Bo, et al. Dual-channel convolutional neural network for power edge image recognition[J]. Journal of Cloud Computing, 2021, 10(1): 18.

[25] 谭宇璇, 樊绍胜. 基于图像增强与深度学习的变电设备红外热像识别方法[J]. 中国电机工程学报, 2021, 41(23): 7990-7998.

Tan Yuxuan, Fan Shaosheng. Infrared thermal image recognition of substation equipment based on image enhancement and deep learning[J]. Proceedings of the CSEE, 2021, 41(23): 7990-7998.

[26] 郑含博, 李金恒, 刘洋, 等. 基于改进YOLOv3的电力设备红外目标检测模型[J]. 电工技术学报, 2021, 36(7): 1389-1398.

Zheng Hanbo, Li Jinheng, Liu Yang, et al. Infrared object detection model for power equipment based on improved YOLOv3[J]. Transactions of China Electro- technical Society, 2021, 36(7): 1389-1398.

[27] Wang C Y, Bochkovskiy A, Liao H M. YOLOv7: trainable bag-of-freebies sets new state-of-the-art for real-time object detectors[C]//2023 IEEE/CVF Confe- rence on Computer Vision and Pattern Recognition (CVPR), Vancouver, BC, Canada, 2023: 7464-7475.

[28] Wang Zhishe, Wu Yuanyuan, Wang Junyao, et al. Res2Fusion: infrared and visible image fusion based on dense Res2net and double nonlocal attention models[J]. IEEE Transactions on Instrumentation Measurement, 2022, 71: TIM.2021.

[29] Li Hui, Xu Tianyang, Wu Xiaojun, et al. LRRNet: a novel representation learning guided fusion network for infrared and visible images[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2023, 45(9): 11040-11052.

[30] Ma Jiayi, Tang Linfeng, Fan Fan, et al. SwinFusion: cross-domain long-range learning for general image fusion via swin transformer[J]. CAA Journal of Auto- matica Sinica, 2022, 9(7): 1200-1217.

[31] Tang Linfeng, Yuan Jiteng, Ma Jiayi. Image fusion in the loop of high-level vision tasks: a semantic-aware real-time infrared and visible image fusion network[J]. Information Fusion, 2022, 82: 28-42.

Abstract The automatic recognition of substation equipment in infrared images is a crucial step for defect and fault diagnosis. However, current methods for substation equipment recognition in infrared images faces challenges such as low accuracy and poor efficiency, primarily due to the complex background of the equipment and the limited information content of single-modal images.

To address this issue, this paper proposes an infrared thermal image enhanced recognition method for substation equipment based on multi-modal image fusion. First, infrared and visible images of five classes of equipment, including arresters, breakers, current transformers, potential transformers, and insulators, are collected, covering multiple voltage levels such as 110 kV, 220 kV, and 500 kV. Subsequently, an unsupervised paradigm for multi-modal image fusion is established. By optimizing the image fusion architecture, feature fusion is integrated into each processing stage. The nonlinear fitting capability of deep convolutional neural networks is leveraged to enhance the adaptive ability of feature fusion. Furthermore, a multi-dimensional cross-connection mechanism is introduced to improve feature flow and utilization efficiency, thereby achieving effective fusion of infrared and visible images. Additionally, the feature extraction network of YOLOv7 is enhanced. A feature preservation strategy is implemented to minimize the loss of detailed information, such as small targets and low-contrast regions, during feature extraction. Simultaneously, a feature cross-connection mechanism is incorporated to strengthen information transfer between shallow and deep features, improving the utilization efficiency of multi-modal features and consequently increasing the recognition accuracy of substation equipment.

The experimental results demonstrate that the unsupervised image fusion model can effectively integrate salient features from both infrared and visible images, exhibiting significant advantages over mainstream methods across four evaluation metrics, including information entropy. Second, the recognition of substation equipment using fused images significantly enhances detection performance, with an increase of 4.08 percentage points in mean average precision, 10.40 percentage points in average recall, 7.65 percentage points in average F1-score, and 5.70 percentage points in overall accuracy. Moreover, compared to the original YOLOv7 network, the enhanced network demonstrates improved performance in substation equipment recognition, achieving a 1.37 percentage points increase in mean average precision, a 0.33 percentage points improvement in F1-score, a 0.61 percentage points enhancement in accuracy, and a 0.28 ms acceleration in average detection speed. Finally, through comparative analysis of recognition results between infrared and fused images under varying environmental conditions, including illumination and weather variations, the robustness of the proposed method is effectively validated.

Based on these results, the following conclusions can be drawn: (1) The proposed method effectively fuses infrared and visible images of substation equipment, enriching the feature information of the equipment in the fused images. (2) The proposed method outperforms single-modal recognition approaches for substation equipment in recognition accuracy and confidence levels. (3) The proposed method effectively mitigates the influence of complex environmental factors, such as lighting and temperature variations, on recognition performance, thereby improving the robustness of substation equipment recognition.

Keywords:Substation equipment, image fusion, automatic recognition, deep learning

杨 帆 男,1980年生,教授,博士生导师,研究方向为电工装备多物理场计算、数字孪生技术、太赫兹成像方法及应用。

E-mail: yangfancqu@gmail.com

李致民 男,1997年生,博士研究生,研究方向为电气设备多模态检测方法、嵌入式AI系统及应用。

E-mail: 1803736962@qq.com(通信作者)

中图分类号:TM507

DOI: 10.19595/j.cnki.1000-6753.tces.250298

中国南方电网有限责任公司科技项目资助(090000KK52220019)。

收稿日期 2025-02-25

改稿日期 2025-03-06

(编辑 李 冰)