特征, 标签

特征, 标签 的标签样本来训练模型,将误差不断反向传播进行梯度更新,以实现准确的预测。如果缺少充足的标签样本,即在小样本条件下,深度学习算法无法学习到准确知识,难以实现较高的预测性能[15]。然而,对于现代电工装备,受客观的模拟、采集条件和设备因素等影响,收集标签需要耗费大量的人力、物力,导致目标任务的标签样本稀缺。历史任务中已有的标签样本充足,且此类样本与目标任务的样本间存在相关的知识信息。但因历史任务和目标任务的样本来源于不同的电工装备,样本分布不同,传统算法模型在此不再适用[16]。

的标签样本来训练模型,将误差不断反向传播进行梯度更新,以实现准确的预测。如果缺少充足的标签样本,即在小样本条件下,深度学习算法无法学习到准确知识,难以实现较高的预测性能[15]。然而,对于现代电工装备,受客观的模拟、采集条件和设备因素等影响,收集标签需要耗费大量的人力、物力,导致目标任务的标签样本稀缺。历史任务中已有的标签样本充足,且此类样本与目标任务的样本间存在相关的知识信息。但因历史任务和目标任务的样本来源于不同的电工装备,样本分布不同,传统算法模型在此不再适用[16]。摘要 使用深度学习算法建立代理模型可实现电工装备性能的快速预测与分析,但其训练过程需大量样本。而现代电工装备的标签样本稀缺,导致模型预测精度低,制约了算法的工程应用。考虑到历史任务中积累的标签样本充足,且此类样本与目标任务的样本间存在相关的知识信息,建立了一种深度迁移学习性能预测方法,将历史电机样本中积累的性能预测知识迁移应用于目标电机性能分析中。首先使用目标域无标签样本对深度置信网络(DBN)进行逐层无监督训练,然后借助源域有标签样本建立参数共享的预训练网络,最后通过少量目标域有标签样本进行适配层训练和全网络微调的方法实现模型迁移。通过结构差异程度不同的Prius电机进行案例验证,结果表明,所提方法能够在满足一定预测精度的情况下,使用较少的标签样本完成目标电机的性能预测任务,为现代电工装备的性能分析与优化提供了新的思路和实践方法。

关键词:永磁同步电机 深度学习 迁移学习 小样本

永磁同步电机(Permanent Magnet Synchronous Motor, PMSM)是一种典型的高效节能电机,被广泛应用于电动汽车、航空航天、工业生产等领域[1-3]。代理模型可替代以有限元为代表的数值模拟参与到电机优化设计中,能够提高性能分析优化的计算效率并减少资源消耗[4],是性能分析与优化的基础和重点,受到国内外专家学者的广泛关注。

代理模型本质上是通过数据驱动方法建立设计参数与性能数据之间的复杂非线性映射关系,实现电工装备性能分析与优化。深度学习作为一种数据驱动方法,通过构建深层网络结构和分层预训练机制模拟人脑学习[5],用非监督式[6]或半监督式[7]的特征学习和特征提取高效算法替代手动获取特征,可以组合低层特征形成更加抽象的高层次属性、类别或特征[8],并在输出层实现分类或回归等决策[9-10],对高维数据的处理能力实现了跨越式发展。在电工装备性能预测与分析领域,深度学习逐渐开始受到研究人员的关注。例如,文献[11]基于深度置信网络(Deep Belief Network, DBN)建立永磁同步电机齿槽转矩预测分析模型,为传统电机设计方法开辟蹊径;文献[12]引入深度神经网络(Deep Neural Network, DNN)建立无铁心永磁同步直线电机的快速计算模型,并进行全局优化以实现推力波动抑制。

深度学习具有强大的特征学习能力,相较于传统机器学习算法能有效地克服对专家经验和数据分析的依赖[13],然而其多层网络结构,含有大量的参数需要学习,训练过程需要大量样本[14]。现有的深度学习算法依赖大量 特征, 标签

特征, 标签 的标签样本来训练模型,将误差不断反向传播进行梯度更新,以实现准确的预测。如果缺少充足的标签样本,即在小样本条件下,深度学习算法无法学习到准确知识,难以实现较高的预测性能[15]。然而,对于现代电工装备,受客观的模拟、采集条件和设备因素等影响,收集标签需要耗费大量的人力、物力,导致目标任务的标签样本稀缺。历史任务中已有的标签样本充足,且此类样本与目标任务的样本间存在相关的知识信息。但因历史任务和目标任务的样本来源于不同的电工装备,样本分布不同,传统算法模型在此不再适用[16]。

的标签样本来训练模型,将误差不断反向传播进行梯度更新,以实现准确的预测。如果缺少充足的标签样本,即在小样本条件下,深度学习算法无法学习到准确知识,难以实现较高的预测性能[15]。然而,对于现代电工装备,受客观的模拟、采集条件和设备因素等影响,收集标签需要耗费大量的人力、物力,导致目标任务的标签样本稀缺。历史任务中已有的标签样本充足,且此类样本与目标任务的样本间存在相关的知识信息。但因历史任务和目标任务的样本来源于不同的电工装备,样本分布不同,传统算法模型在此不再适用[16]。

迁移学习[17]可以解决目标任务标签样本量少以及历史任务和目标任务样本分布不一致所引发的无法有效建模问题,其将在源域上学习到的知识应用到另一个相似领域即目标域中去[18]。迁移学习的提出放宽了传统算法模型中训练和测试的样本需满足独立同分布、训练样本充足且有代表性两个基本假设[19]。在性能预测方面,文献[20]提出将迁移学习与材料性能预测模型相结合的方法,实现小样本下材料性能的有效预测。文献[21]提出一种最小二乘归纳式迁移学习方法,实现对离心式水泵的性能预测。文献[22]在有大规模机队样本作为参照的条件下,使用迁移学习方法解决小规模机队发动机的修后性能预测所面临的样本量不足问题。深度学习具有强大的自动特征提取能力,迁移学习具有跨领域学习知识的特点,深度迁移学习将两者进行结合,可有效提高算法的学习与泛化能力。近些年来,有学者将深度迁移学习应用于电工装备领域[23-25],但目前多用于分类问题,在回归领域中的研究十分有限。

在电工装备领域的性能预测任务中,无标签特征样本较多,而有标签样本量稀少。本文将DBN与模型迁移方法进行结合,DBN能够对目标域无标签样本进行特征自学习;模型迁移能够克服不同数据之间的分布差异,同时解决目标域有标签样本稀缺的问题。具体来讲,首先使用目标电机无标签样本对DBN进行逐层无监督训练;然后借助历史电机有标签样本建立参数共享的预训练网络;最后通过冻结网络、训练适配层和微调全网络的方法实现模型迁移。在结构差异程度不同的永磁同步电机上进行案例验证,并与多个模型进行预测效果对比分析。结果表明,所提方法能够在小样本条件下完成目标电机的性能预测任务。

给定两个数据域 和

和 ,其中

,其中 或

或 即源域或目标域。

即源域或目标域。 和

和 都由其特征空间

都由其特征空间 及概率分布

及概率分布 构成,即

构成,即 ,

, ,其中样本特征

,其中样本特征 。对于域内的任务T由标签空间

。对于域内的任务T由标签空间 和映射函数

和映射函数 组成,即

组成,即 ,

,

,样本标签

,样本标签 。在满足

。在满足 ,

, ,

, 的条件下,迁移学习的目标是学习预测函数

的条件下,迁移学习的目标是学习预测函数 :

: ,在

,在 上泛化误差低。

上泛化误差低。

深度学习与迁移学习的比较如图1所示。图1中不同形状代表不同领域的数据。传统深度学习算法要针对不同领域的数据训练不同的模型;迁移学习方法将在源任务上训练好的深度学习模型作为源模型,从源模型中学习到的知识出发,结合目标任务的数据特征,在源模型的基础上进行适当调整,使其适应目标任务的数据表达,实现不同领域数据的识别和预测,克服了传统算法模型的缺点。

图1 深度学习与迁移学习的比较

Fig.1 Comparison of deep learning and transfer learning

深度迁移学习是指由 确定的学习,其中函数

确定的学习,其中函数 是深度网络。使用深度网络实现迁移学习的方法中,基于对抗的领域自适应多适用于分类任务,基于模型的迁移适用于回归问题。考虑到数据特征和任务特征以及迁移的可行性与方便性,本文采用基于模型的深度迁移学习方法。

是深度网络。使用深度网络实现迁移学习的方法中,基于对抗的领域自适应多适用于分类任务,基于模型的迁移适用于回归问题。考虑到数据特征和任务特征以及迁移的可行性与方便性,本文采用基于模型的深度迁移学习方法。

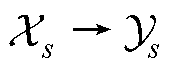

基于深度迁移学习的性能预测框架如图2所示。选择历史电机数据集为源域,目标电机数据集为目标域。其中源域全部有标签,目标域只有少量标签。通过历史电机的数据训练深度学习模型,建立由历史电机设计参数的特征空间 至性能数据的标签空间

至性能数据的标签空间 的非线性映射关系

的非线性映射关系 :

: ,即为获取的电机性能预测知识。由于不同电机的数据之间存在分布差异,历史电机的性能预测知识

,即为获取的电机性能预测知识。由于不同电机的数据之间存在分布差异,历史电机的性能预测知识 不能准确地实现目标电机的性能分析。深度迁移学习将从历史电机数据中学习到的知识

不能准确地实现目标电机的性能分析。深度迁移学习将从历史电机数据中学习到的知识 ,迁移应用到目标电机性能分析中,使用极少量目标电机有标签样本,建立电机性能预测方法,实现目标电机设计参数与性能数据的映射。

,迁移应用到目标电机性能分析中,使用极少量目标电机有标签样本,建立电机性能预测方法,实现目标电机设计参数与性能数据的映射。

图2 基于深度迁移学习的性能预测框架

Fig.2 The performance prediction thinking framework based on deep transfer learning

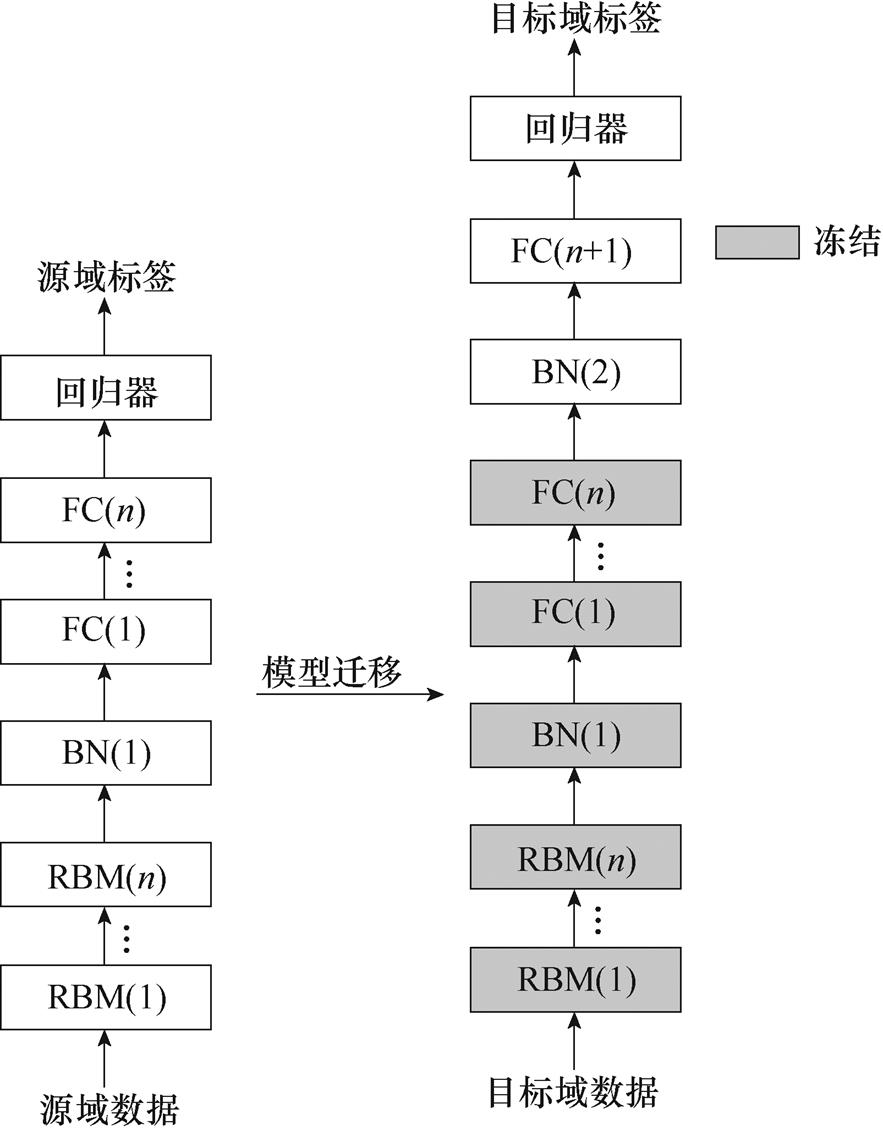

建立的深度迁移学习模型如图3所示。建模过程主要分为DBN无监督训练、预训练深度置信网络(pre-training Deep Belief Network-Deep Neural Network, pDBN-DNN)的建立和模型迁移三部分。

图3 深度迁移学习模型

Fig.3 Deep transfer learning model

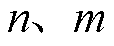

使用DBN对目标域无标签样本进行无监督学习,获得高度抽象的重要特征。目标域一般存在大量无标签样本,进行数据挖掘将有助于揭示特征情况。DBN由多个受限玻耳兹曼机(Restrict Boltzmann Machine, RBM)堆叠而成。DBN无监督训练采用无标签样本,从网络的输入层开始训练各层参数,自动获取潜藏在数据中难以解读的深层次信息。当最后一个RBM训练结束时,完成对DBN网络参数的初始化。

RBM是一个能量模型,对于一组状态量 ,能量函数定义为

,能量函数定义为 ,隐含层与可视层的联合概率分布定义为

,隐含层与可视层的联合概率分布定义为 ,即

,即

(1)

(1)

式中, 分别为可见层、隐藏层的状态;

分别为可见层、隐藏层的状态; 分别为可见层、隐藏层的偏置;

分别为可见层、隐藏层的偏置; 分别为可见层、隐藏层单元个数;

分别为可见层、隐藏层单元个数; 为

为 与

与 之间的权重;

之间的权重; 为模型的参数,

为模型的参数, ;

; 为归一化系数。

为归一化系数。

RBM的可见层(隐藏层)神经元的状态是条件独立的,由此可计算各神经元取值条件概率为

(2)

(2)

式中, 为激活函数。

为激活函数。

本文采用对比散度(Contrastive Divergence, CD)算法[26]训练RBM,计算方法为

(3)

(3)

式中, 为学习率;

为学习率; 为数据分布的期望;

为数据分布的期望; 为模型定义的期望。

为模型定义的期望。

使用目标域无标签样本对DBN进行无监督训练后,在此基础上借助大量源域有标签样本建立参数共享的pDBN-DNN。先将DBN扩展为深度置信网络-深度神经网络(DBN-DNN),然后使用源域数据集对建立的DBN-DNN进行训练。训练过程分为无监督学习与有监督学习两阶段。网络参数训练完成后,得到pDBN-DNN。pDBN-DNN结构如图4所示。

图4 pDBN-DNN结构

Fig.4 pDBN-DNN structure

在pDBN-DNN的基础上,进行模型迁移。如何迁移已有知识以适配目标域数据以及最大化目标域数据价值是模型迁移的关键。模型迁移过程如图5所示。本文结合迁移学习中的Finetune思想,将已训练好的pDBN-DNN参数冻结,使用少量目标域有标签样本对增加的适配层进行训练。选取批归一化(Batch Normalization, BN)层和全连接(Fully Connected, FC)层作为适配层。其中,BN层能够加快网络学习速度,且有利于解决模型因目标域有标签样本少而出现过拟合的问题。在回归器前增加的FC层可以让网络在保存源域有价值信息的基础上进一步学习目标域信息。网络训练至测试集误差稳定收敛时取消冻结,使用较小的学习率对整个网络进行微调,最终得到能够有效预测目标域数据的深度迁移学习模型(Transfer Learning-DBN-DNN, TL-DBN-DNN)。

图5 模型迁移过程

Fig.5 Model migration process

电机性能预测实现流程如图6所示。其中电机无标签样本指电机不含标签的特征样本,电机有标签样本指电机含标签的 特征, 标签

特征, 标签 样本。

样本。

(1)数据采样及预处理。通过PMSM模型建立设计参数与性能数据的样本集,进行数据归一化处理。

(2)建立TL-DBN-DNN模型。首先使用目标电机无标签样本对DBN进行无监督训练;其次使用历史电机的有标签样本建立参数共享的pDBN- DNN;最后进行模型迁移,使用少量目标电机的有标签样本完成网络结构的训练与更新,得到最终的TL-DBN-DNN模型。

图6 电机性能预测实现流程

Fig.6 Motor performance prediction implementation process

(3)预测电机性能数据。将目标电机的设计参数输入所建立的TL-DBN-DNN模型,输出其相应的性能数据预测值。

(4)结果分析。选取评价指标,进行误差分析。

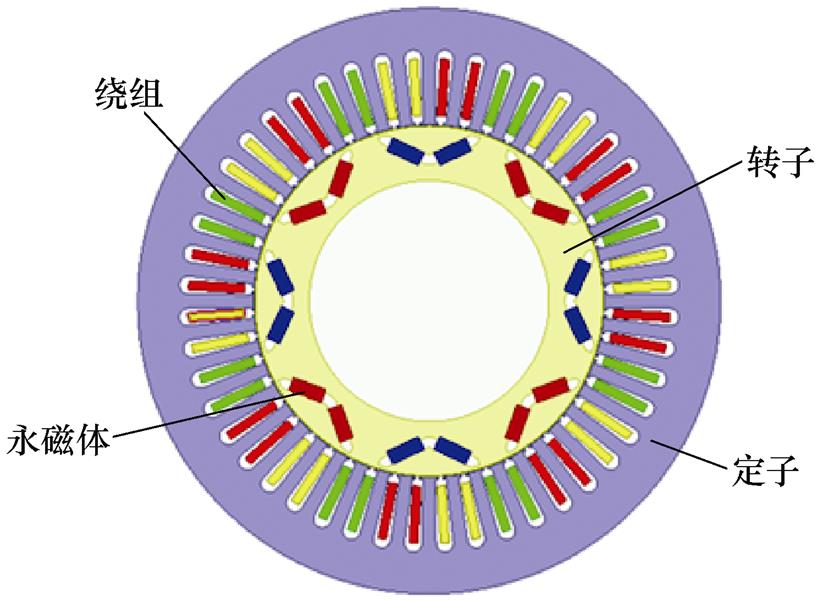

2004、2010及2017款永磁同步电机分别是第Ⅱ、Ⅲ、Ⅳ代普锐斯(Prius)混合动力汽车的驱动电机,且均有公开测试数据[27-28],故本文选取2004、2010、2017款永磁同步电机作为研究对象,并依次编号为电机1、电机2、电机3。其中,电机1的二维仿真模型如图7所示。

图7 电机1的二维仿真模型

Fig.7 Two-dimensional simulation model of motor 1

三款电机关键尺寸对比见表1。其中电机2和电机1相比,整体结构较为相似,两者定子外径及转子外径的尺寸一致,铁心长度和气隙长度有少许差别,均内置“V”型永磁体,但电机2增加了中间磁桥,且转子外圆开有辅助槽。电机3和电机1相比,整体结构相差较大,定子外径及转子外径的尺寸大幅度减小,铁心长度和气隙长度有少许差别,电机3内置“V+一”型永磁体,增加了中间磁桥,且转子外圆开有辅助槽。

表1 三款电机关键尺寸对比

Tab.1 Comparison of key dimensions of three motors (单位: mm)

关键尺寸电机1电机2电机3 定子外径269.00269.00215.00 转子外径161.80161.80140.50 铁心长度58.0050.8061.00 气隙长度0.750.730.70

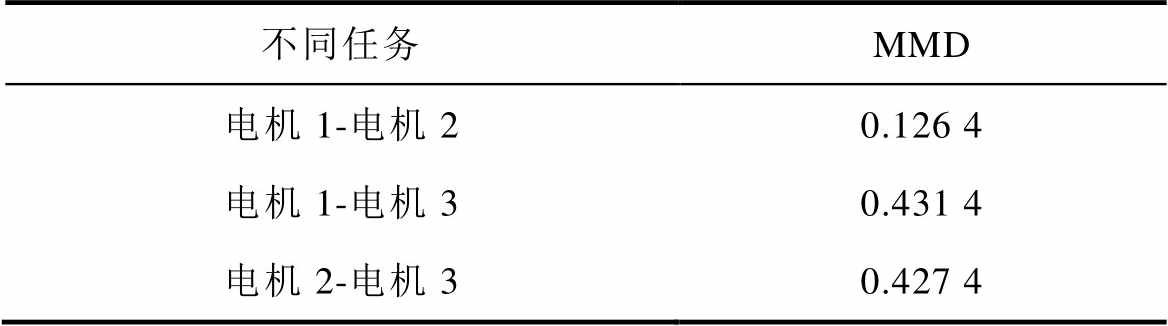

为进一步说明不同电机间的差异程度,引入最大均值差异(Maximum Mean Discrepancy, MMD)[29]算法,度量源域数据与目标域数据的分布差异。MMD值越小,说明两个数据分布越相似。不同电机间数据分布的差异程度见表2。

表2 电机间数据分布的差异程度

Tab.2 Difference degree of data distribution between motors

不同任务MMD 电机1-电机20.126 4 电机1-电机30.431 4 电机2-电机30.427 4

本文选取6个结构参数作为输入变量,对应于特征;选取输出功率和转矩脉动作为输出变量,对应于标签。三款电机设计参数取值范围见表3。其中定子槽口宽度为3水平取值,永磁体厚度、永磁体宽度、定子槽高、气隙长度、定子槽口高度为4水平取值,以有限元软件为计算工具,分析计算不同设计参数下的电机输出功率和转矩脉动得到数据集。数据集中三款电机的数据量各为3 072组。

表3 三款电机设计参数取值范围

Tab.3 The range of design parameters of the three motors (单位: mm)

结构参数电机1电机2电机3 永磁体厚度4.80~7.805.00~8.004.00~5.50 永磁体宽度29.00~33.5033.50~36.509.50~12.50 定子槽高28.00~31.0029.00~32.0033.00~36.00 气隙长度0.65~0.800.67~0.820.85~1.00 定子槽口高度4.40~7.404.20~7.207.50~10.50 定子槽口宽度1.61~2.611.28~2.281.00~2.00

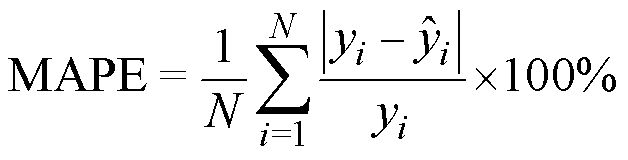

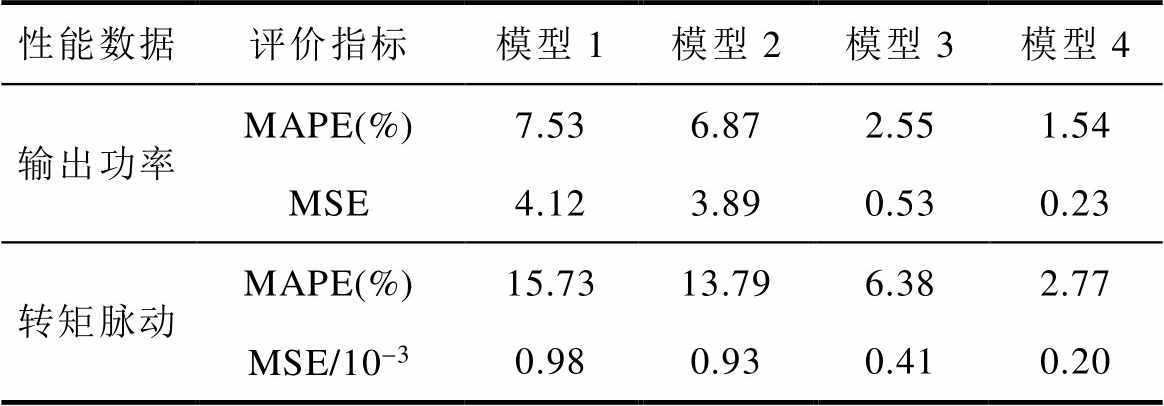

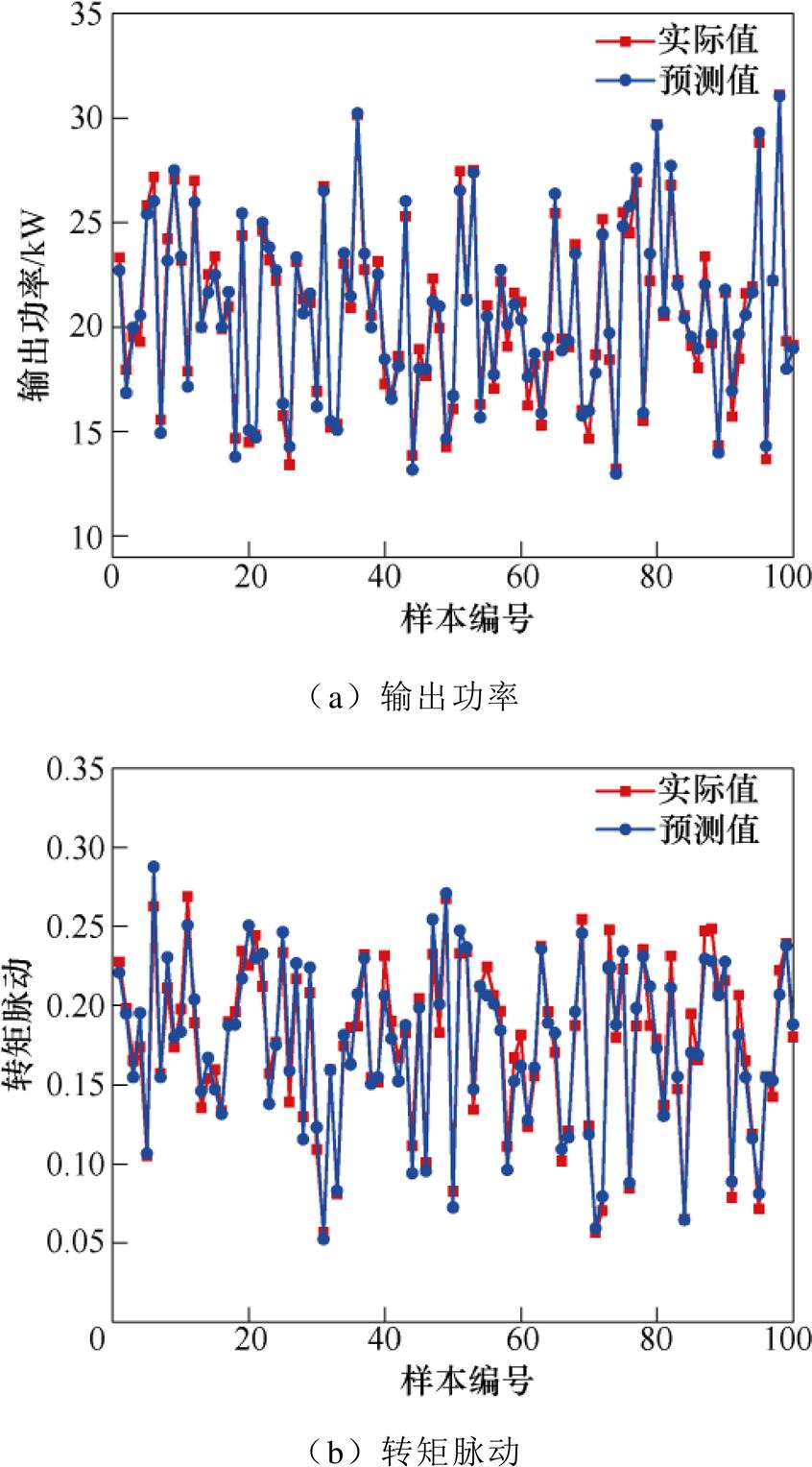

本文选取平均绝对百分误差(Mean Absolute Percentage Error, MAPE)、均方误差(Mean Squared Error, MSE)两个评估指标衡量预测模型的优劣,有

(4)

(4)

(5)

(5)

式中,N为样本个数; 和

和 分别为第

分别为第 个样本的预测值和实际值。MAPE和MSE的取值范围均为[0, +∞),数值越小,说明预测值与实际值越接近,模型预测效果越好。

个样本的预测值和实际值。MAPE和MSE的取值范围均为[0, +∞),数值越小,说明预测值与实际值越接近,模型预测效果越好。

这里以电机1数据为源域,电机2数据为目标域,输出功率为预测性能数据,进行模型训练过程的调试,探究不同因素对模型预测效果的影响。

4.1.1 DBN无监督训练对模型精度的影响

使用目标域无标签样本对DBN进行无监督训练有助于揭示特征情况,使得模型参数适应于目标域样本的特征表达。为了验证算法的先进性和有效性,分别在使用和未使用目标域无标签样本对DBN进行无监督训练的情况下,进行测试,结果见表4。使用目标域无标签样本对DBN进行无监督训练时,具有更高的预测精度。

表4 模型测试效果

Tab.4 Test results of model

目标域无标签样本MAPE(%)MSE 使用1.540.23 未使用3.090.98

4.1.2 全网络微调对迁移效果的影响

模型迁移过程分为适配层训练和全网络微调,选择MSE函数作为训练过程的损失函数来调整所有层的权重。训练过程收敛效果如图8所示。由适配层训练到全网络微调,误差随迭代次数的变化曲线可以进一步收敛,进而提高模型预测精度。

图8 训练过程收敛效果

Fig.8 Convergence effect of training process

分别在适配层训练后和全网络微调后,对模型预测效果进行对比,结果见表5。经过全网络微调后,模型的预测精度得到提升。

表5 模型预测效果对比

Tab.5 Comparison of model prediction effect

评价指标适配层训练全网络微调 MAPE(%)2.601.54 MSE0.580.23

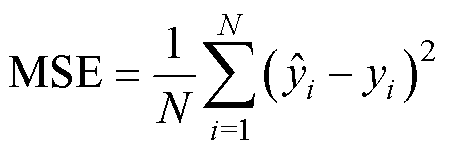

电机1与电机2结构较为相似,电机1与电机3结构相差较大。分别将电机1-电机2、电机1-电机3作为相似电机组与差异电机组,使用四种算法建立电机性能预测模型:DBN-DNN、域对抗神经网络(Domain-Adversarial Neural Network, DANN)[30]、DBN-DNN-Finetune、TL-DBN-DNN。将四种模型分别命名为模型1、模型2、模型3、模型4,使用历史电机数据和5%的目标电机数据进行训练,目标电机剩余数据作为测试。

1)案例一:相似电机组实验结果与分析

电机1-电机2为相似电机组,其中电机1为历史电机,电机2为目标电机。设置网络结构时选择隐含层数为4,每层的神经元个数为32、24、18、12。DBN无监督训练使用随机梯度下降(Stochastic Gradient Decent, SGD)优化器,学习率为0.01,pDBN-DNN训练、适配层训练和全网络微调使用自适应矩估计(Adaptive Moment Estimation, Adam)优化器,学习率分别为0.01、0.001和0.000 1。从测试数据中随机挑选100组,输出功率、转矩脉动的预测值与实际值的对比如图9所示。

电机2不同模型预测效果对比见表6。模型1作为传统的深度学习算法,由于不具备跨任务学习能力,导致预测误差高。模型2作为无监督学习算法,多用于分类问题中,通过领域对抗将目标域上不同类之间的决策边界的距离扩大,从而有助于模型泛化到目标域。而本文的性能预测为典型的回归问题,输出空间是连续的,不存在明确的决策边界,大多时候模型训练困难且精度不高。模型3是在pDBN-DNN的基础上使用少量的目标域有标签样本进行了有监督训练,实现了微调,因此误差更低。在训练好的pDBN-DNN基础上添加适配层建立的模型4,获得了新的学习空间,且通过实现适配层待训练参数和目标域有标签样本在数量上的匹配,使用少量目标域有标签样本便使得预测误差最低。

图9 电机2性能数据预测效果

Fig.9 Prediction effect of motor 2 performance data

表6 电机2不同模型预测误差

Tab.6 Prediction error of different models of motor 2

性能数据评价指标模型1模型2模型3模型4 输出功率MAPE(%)7.536.872.551.54 MSE4.123.890.530.23 转矩脉动MAPE(%)15.7313.796.382.77 MSE/10-30.980.930.410.20

2)案例二:差异电机组实验结果与分析

电机1-电机3为差异电机组,其中电机1为历史电机,电机3为目标电机。设置网络结构时选择隐含层数为5,每层的神经元个数为32、24、18、14、10。DBN无监督训练使用SGD优化器,学习率为0.02,pDBN-DNN训练、适配层训练和全网络微调使用Adam优化器,学习率分别为0.01、0.002和0.000 1。从测试数据中随机挑选100组,输出功率、转矩脉动的预测值与实际值的对比如图10所示。

图10 电机3性能数据预测效果

Fig.10 Prediction effect of motor 3 performance data

差异电机组不同模型预测效果对比见表7。差异电机组相较于相似电机组,电机间结构差异程度的增大导致源域和目标域数据分布差异变大。此时前三种模型预测误差显著增大,本文提出的TL- DBN-DNN模型预测误差仍为最低。

表7 电机3不同模型预测误差

Tab.7 Prediction error of different models of motor 3

性能数据评价指标模型1模型2模型3模型4 输出功率MAPE(%)21.5017.918.062.73 MSE13.3411.584.020.55 转矩脉动MAPE(%)35.9028.3711.284.37 MSE/10-33.212.560.840.36

通过相似电机组与差异电机组两组案例验证,对四种模型进行综合性能分析,结果表明,TL-DBN- DNN模型预测效果最好。

模型的泛化能力是性能预测方法不可忽略的方面,只有具有较强的泛化能力,预测模型才具有应对实际情况的能力。为进一步验证本文构建的迁移模型的泛化能力,新增电机2-电机3、电机2-电机1、电机3-电机1、电机3-电机2为案例进行测试,测试结果见表8。

表8 模型泛化能力测试

Tab.8 Model generalization capability test

性能数据评价指标2-32-13-13-2 输出功率MAPE(%)2.361.482.221.78 MSE0.500.711.200.32 转矩脉动MAPE(%)4.132.394.053.87 MSE/10-30.320.130.210.28

这里以电机2的输出功率为预测性能数据,以平均绝对百分误差值作为主要评价指标,在目标域标签样本占比(指目标域中有标签训练样本个数占总样本数的比例)不同时,考虑需使用有限元软件采样的计算时间,并对比TL-DBN-DNN模型与DBN-DNN模型的预测效果,见表9。

表9 电机2不同目标域标签占比时预测效果对比

Tab.9 Comparison of prediction effects of different target domain labels in motor 2

目标域标签样本占比(%)有限元采样耗时/minDBN-DNN (%)TL-DBN-DNN (%) 52319.191.54 209215.831.06 401 9343.990.71 602 7651.620.52

由表9可知,DBN-DNN模型的目标域标签样本占比直至增加到60%时,和TL-DBN-DNN模型的标签样本占比为5%时预测精度接近。此时,模型训练时间相差0.9 min,但TL-DBN-DNN模型可减少约55%的目标域标签样本,节省约2 534 min的有限元采样计算时间。进一步对比电机3不同目标域标签样本占比时模型预测效果,见表10。因此,使用TL-DBN-DNN模型可以大幅度降低有限元的样本计算量和时间成本。

表10 电机3不同目标域标签占比时预测效果对比

Tab.10 Comparison of prediction effects of different target domain labels in motor 3

目标域标签样本占比(%)有限元采样耗时/minDBN-DNN (%)TL-DBN-DNN (%) 52159.902.73 208607.192.12 401 7204.011.03 602 5801.980.81

本文建立了一种深度迁移学习方法,用于小样本下永磁同步电机的性能预测与分析,将在电机智能设计领域中发挥重要作用。具体结论如下:

1)DBN的无监督学习使其获得了目标域的重要特征,并用源域有标签样本再训练建立了参数共享的pDBN-DNN网络。

2)在pDBN-DNN的基础上,通过网络冻结、适配层训练和全网络微调建立了模型迁移的TL- DBN-DNN模型。

3)仅使用5%的目标域标签样本时,TL-DBN- DNN模型的精度和传统算法相仿,但减少使用约35%~55%的目标域标签样本。

本研究对不同任务的数据进行挖掘和关联,实现了知识迁移。考虑到模拟与实验数据间的可迁移性,亦可推至涉及生产、运行、可靠性等领域。

参考文献

[1] Guo Hong, Xu Jinquan, Chen Y H. Robust control of fault-tolerant permanent-magnet synchronous motor for aerospace application with guaranteed fault switch process[J]. IEEE Transactions on Industrial Elec- tronics, 2015, 62(12): 7309-7321.

[2] 李晓华, 赵容健, 田晓彤, 等. 逆变器供电对电动汽车内置式永磁同步电机振动噪声特性影响研究[J]. 电工技术学报, 2020, 35(21): 4455-4464.

Li Xiaohua, Zhao Rongjian, Tian Xiaotong, et al. Study on vibration and noise characteristics of interior permanent magnet synchronous machine for electric vehicles by inverter[J]. Transactions of China Electrotechnical Society, 2020, 35(21): 4455-4464.

[3] 曹春堂, 兰志勇, 沈凡享. 永磁同步电机无位置传感器控制系统中初始位置角检测综述[J]. 电气技术, 2020, 21(6): 1-6.

Cao Chuntang, Lan Zhiyong, Shen Fanxiang. Review of initial position angle detection in sensorless control system of permanent magnet synchronous motor[J]. Electrical Engineering, 2020, 21(6): 1-6.

[4] 谢冰川, 张岳, 徐振耀, 等. 基于代理模型的电机多学科优化关键技术综述[J]. 电工技术学报, 2022, 37(20): 5117-5143.

Xie Bingchuan, Zhang Yue, Xu Zhenyao, et al. Review on multidisciplinary optimization key tech- nology of electrical machine based on surrogate models[J]. Transactions of China Electrotechnical Society, 2022, 37(20): 5117-5143.

[5] 乔俊飞, 王功明, 李晓理, 等. 基于自适应学习率的深度信念网设计与应用[J]. 自动化学报, 2017, 43(8): 1339-1349.

Qiao Junfei, Wang Gongming, Li Xiaoli, et al. Design and application of deep belief network with adaptive learning rate[J]. Acta Automatica Sinica, 2017, 43(8): 1339-1349.

[6] 仲林林, 胡霞, 刘柯妤. 基于改进生成对抗网络的无人机电力杆塔巡检图像异常检测[J]. 电工技术学报, 2022, 37(9): 2230-2240, 2262.

Zhong Linlin, Hu Xia, Liu Keyu. Power tower anomaly detection from unmanned aerial vehicles inspection images based on improved generative adversarial network[J]. Transactions of China Elec- trotechnical Society, 2022, 37(9): 2230-2240, 2262.

[7] Yan Jiongcheng, Li Changgang, Liu Yutian. Insecu- rity early warning for large scale hybrid AC/DC grids based on decision tree and semi-supervised deep learning[J]. IEEE Transactions on Power Systems, 2021, 36(6): 5020-5031.

[8] Lu Na, Li Tengfei, Ren Xiaodong, et al. A deep learning scheme for motor imagery classification based on restricted Boltzmann machines[J]. IEEE Transactions on Neural Systems and Rehabilitation Engineering, 2017, 25(6): 566-576.

[9] Beers A, Brown J, Chang Ken, et al. DeepNeuro: an open-source deep learning toolbox for neuroima- ging[J]. Neuroinformatics, 2021, 19(1): 127-140.

[10] 卢锦玲, 郭鲁豫. 基于改进深度残差收缩网络的电力系统暂态稳定评估[J]. 电工技术学报, 2021, 36(11): 2233-2244.

Lu Jinling, Guo Luyu. Power system transient stability assessment based on improved deep residual shrinkage network[J]. Transactions of China Elec- trotechnical Society, 2021, 36(11): 2233-2244.

[11] 金亮, 王飞, 杨庆新, 等. 永磁同步电机性能分析的典型深度学习模型与训练方法[J]. 电工技术学报, 2018, 33(增刊1): 41-48.

Jin Liang, Wang Fei, Yang Qingxin, et al. Typical deep learning model and training method for per- formance analysis of permanent magnet synchronous motor[J]. Transactions of China Electrotechnical Society, 2018, 33(S1): 41-48.

[12] 杨阳, 赵吉文, 宋俊材, 等. 基于深度神经网络模型的无铁心永磁同步直线电机结构优化研究[J]. 中国电机工程学报, 2019, 39(20): 6085-6094, 6189.

Yang Yang, Zhao Jiwen, Song Juncai, et al. Structural optimization of air-core permanent magnet syn- chronous linear motors based on deep neural network models[J]. Proceedings of the CSEE, 2019, 39(20): 6085-6094, 6189.

[13] Wang Yanbin, You Zhuhong, Li Xiao, et al. Predi- cting protein-protein interactions from protein sequences by a stacked sparse autoencoder deep neural network[J]. Molecular BioSystems, 2017, 13(7): 1336-1344.

[14] Li Chuan, Zhang Shaohui, Qin Yi, et al. A systematic review of deep transfer learning for machinery fault diagnosis[J]. Neurocomputing, 2020, 407: 121-135.

[15] 陈祝云. 基于深度迁移学习的机械设备智能诊断方法研究[D]. 广州: 华南理工大学, 2020.

[16] 陶卓. 面向少标签和无标签分类任务的迁移学习方法[D]. 北京: 北京邮电大学, 2021.

[17] Weiss K, Khoshgoftaar T M, Wang Dingding. A survey of transfer learning[J]. Journal of Big Data, 2016, 3(1): 1-40.

[18] 陈剑, 杜文娟, 王海风. 基于对抗式迁移学习的含柔性高压直流输电的风电系统次同步振荡源定位[J]. 电工技术学报, 2021, 36(22): 4703-4715.

Chen Jian, Du Wenjuan, Wang Haifeng. Location method of subsynchronous oscillation source in wind power system with VSC-HVDC based on adversarial transfer learning[J]. Transactions of China Electro- technical Society, 2021, 36(22): 4703-4715.

[19] 庄福振, 罗平, 何清, 等. 迁移学习研究进展[J]. 软件学报, 2015, 26(1): 26-39.

Zhuang Fuzhen, Luo Ping, He Qing, et al. Survey on transfer learning research[J]. Journal of Software, 2015, 26(1): 26-39.

[20] Dong Rongzhi, Dan Yabo, Li Xiang, et al. Inverse design of composite metal oxide optical materials based on deep transfer learning and global optimi- zation[J]. Computational Materials Science, 2021, 188: 110166.

[21] 杨鑫宇, 吕政, 赵珺, 等. 基于迁移学习的离心式水泵扬程性能预测[J]. 控制理论与应用, 2021, 38(5): 615-622.

Yang Xinyu, Lü Zheng, Zhao Jun, et al. Prediction of lift performance of centrifugal pump based on transfer learning[J]. Control Theory & Applications, 2021, 38(5): 615-622.

[22] 谭治学. 多源信息融合的民航发动机性能预测方法研究[D]. 哈尔滨: 哈尔滨工业大学, 2018.

[23] Xu Gaowei, Liu Min, Jiang Zhuofu, et al. Online fault diagnosis method based on transfer convolutional neural networks[J]. IEEE Transactions on Instru- mentation and Measurement, 2020, 69(2): 509- 520.

[24] 康守强, 胡明武, 王玉静, 等. 基于特征迁移学习的变工况下滚动轴承故障诊断方法[J]. 中国电机工程学报, 2019, 39(3): 764-772, 955.

Kang Shouqiang, Hu Mingwu, Wang Yujing, et al. Fault diagnosis method of a rolling bearing under variable working conditions based on feature transfer learning[J]. Proceedings of the CSEE, 2019, 39(3): 764-772, 955.

[25] 王艳新, 闫静, 王建华, 等. 基于域对抗迁移卷积神经网络的小样本GIS绝缘缺陷智能诊断方法[J]. 电工技术学报, 2022, 37(9): 2150-2160.

Wang Yanxin, Yan Jing, Wang Jianhua, et al. Intelligent diagnosis for GIS with small samples using a novel adversarial transfer learning in convolutional neural network[J]. Transactions of China Electro- technical Society, 2022, 37(9): 2150-2160.

[26] Hinton G E. Training products of experts by mini- mizing contrastive divergence[J]. Neural Computation, 2002, 14(8): 1771-1800.

[27] Ayers C W. Evaluation of 2004 Toyota prius hybrid electric drive system interim report[R]. Oak Ridge National Laboratory, 2004.

[28] Burress T A, Campbell S L, Coomer C, et al. Evaluation of the 2010 Toyota prius hybrid synergy drive system[R]. Oak Ridge National Laboratory, 2011.

[29] Pan S J, Yang Qiang. A survey on transfer learning[J]. IEEE Transactions on Knowledge and Data Engin- eering, 2010, 22(10): 1345-1359.

[30] Ganin Y, Lempitsky V S. Unsupervised domain adaptation by backpropagation[C]//International Con- ference on Machine Learning, Lille, France, 2015, 37: 1180-1189.

Abstract A permanent magnet synchronous motor (PMSM) is a typical high-efficiency and energy-saving motor. The surrogate model can replace the numerical simulation represented by the finite element method to participate in the motor optimization design, which can improve the calculation efficiency of performance analysis and optimization and reduce resource consumption. It is the basis and focus of performance analysis and optimization. Using a deep learning algorithm to establish a surrogate model can achieve fast prediction and analysis of motor performance, but its training process requires a large number of samples. Besides, the model prediction accuracy is low when the samples are insufficient, which restricts the application of the algorithm in engineering. It is necessary to consider that the label samples accumulated in the historical task are sufficient. There is relevant knowledge information between such samples and the samples of the target task. Consequently, this paper focuses on the following aspects: (1) Establish a deep learning method for transfer performance prediction; (2) Apply the performance prediction knowledge transfer accumulated in the historical motor samples to the performance analysis of the target motor; (3) Realize the performance prediction task of the target motor under the condition of a few-shot.

In electrical equipment performance prediction, there are many unlabeled feature samples and few labeled samples. Combined with the deep belief network (DBN) and the model transfer method, DBN can self-learn the characteristics of unlabeled samples in the target domain; model transfer can overcome the distribution difference between different data and solve the problem of scarcity of labeled samples in the target domain. The historical motor data are set as the source domain and the target motor data as the target domain. Firstly, the DBN is trained layer by layer unsupervised using the unlabeled samples of the target motor to obtain highly abstract important features. Secondly, a parameter-sharing pre-training network is established using the labeled samples of historical motors. Finally, the model transfer is realized by freezing the network, training the adaptation layer, and fine-tuning the whole network. Moreover, a deep transfer learning model is obtained to effectively predict the target domain data.

Taking 2004, 2010, and 2017 Prius vehicles PMSMs as the research object, using two-dimension finite element analysis (2D-FEA) as the calculation tool, the data set is obtained by analyzing and calculating the motor output power and torque ripple under different design parameters. Considering the degree of structural difference between different motors, the case of similar and differential motor groups is verified, and the generalization ability of the model is further tested. Through the comparison and analysis between several models, the progressiveness and effectiveness of the method are verified. When only 5% labeled samples of the target motor are used, the mean absolute percentage error (MAPE) of output power and torque ripple for the similar motor group are 1.54% and 2.77%, respectively. Similarly, the MAPE values of output power and torque ripple for differential motor groups are 2.73% and 4.37%, respectively. When the precision is close to that of the traditional algorithm, the target domain label samples can be reduced by 35%~55%. The results show that the proposed method can predict the performance of the target motor under the condition of a few-shot.

keywords:Permanent magnet synchronous motor, deep learning, transfer learning, few-shot

DOI: 10.19595/j.cnki.1000-6753.tces.221454

中图分类号:TM351

国家自然科学基金面上项目(51977148)、国家自然科学基金重大研究计划项目(92066206)和中央引导地方科技发展专项自由探索项目(226Z4503G)资助。

收稿日期 2022-07-28

改稿日期 2022-11-09

金 亮 男,1982年生,博士,教授,研究方向为工程电磁场与磁技术、电磁场云计算和电磁无损检测等。E-mail: jinlnet@gmail.com(通信作者)

闫银刚 男,1997年生,硕士研究生,研究方向为工程电磁场。E-mail: yyg1997@163.com

(编辑 崔文静)