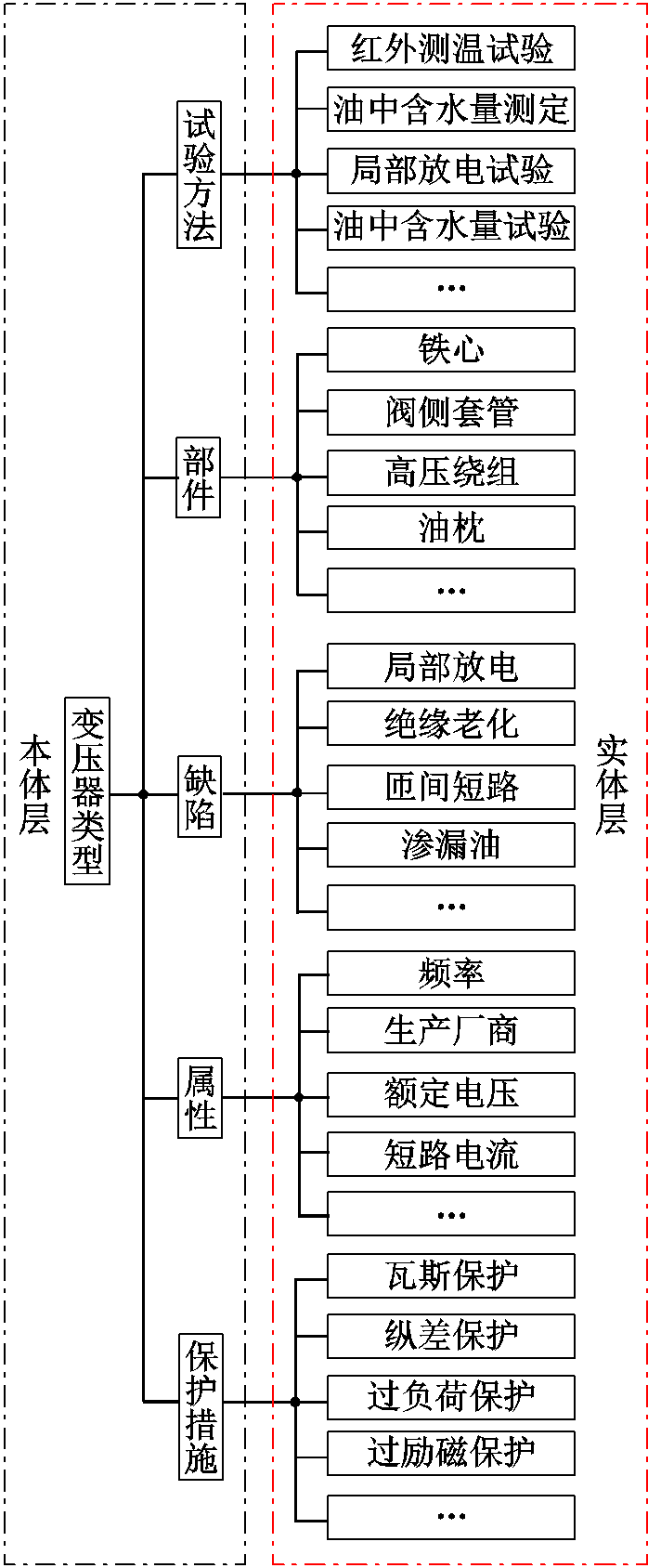

图1 变压器运维知识图谱结构示意图

Fig.1 Schematic diagram of transformer operation and maintenance knowledge graph structure

摘要 当前电网数字化转型升级,且电力变压器智能健康管理技术快速发展,而在运维过程中存在信息关联性弱以及决策生成效率低的问题。目前,知识图谱在航天器运维等其他工业领域已有应用,知识查询效率显著提升。电力变压器运维领域鲜有知识图谱构建相关文献,且针对电力变压器运维领域公开数据较少、运维知识难以被有效挖掘的问题,该文提出一种基于ALBERT的电力变压器运维知识图谱构建方法。首先获取电力变压器领域公开文献,并使用正则匹配的样本生成方法对电力系统事故调查报告等半结构化语料进行样本增强,构建电力变压器运维领域的训练数据集;然后应用ALBERT-BiLSTM-CRF深度学习算法从电力变压器相关文献与事故调查报告中抽取了电力变压器运维实体,并将此算法与传统深度学习算法进行对比,验证了此方法的优越性;接着,利用融入了ALBERT和注意力机制的ALBERT-BiLSTM-Attention深度学习算法对电力变压器运维实体进行关系抽取,相较于其他深度学习算法,此算法在电力变压器运维领域文本中具有更好的表现;最后使用Neo4j图数据库对知识图谱进行可视化呈现,并实现了基于电力变压器运维知识图谱的辅助决策功能。

关键词:电力变压器 知识图谱 深度学习 ALBERT 辅助决策

我国提出“2030年前实现碳达峰,2060年前实现碳中和”行动方案,大力推动电网数字化转型升级[1],这对传统电力设备的运行维护提出了更高的要求[2]。变压器作为电力系统中的核心设备,不同程度的电力变压器故障都会对整个电网的安全稳定运行产生挑战。快速准确地掌握变压器信息,提升变压器检修维护效率和水平,是保证用户用电质量的重要基础。

当前变压器运维主要依赖传统经验,导致运维措施可解释性较弱,且运维人员对故障变化反应较慢,无法及时对故障进行快速准确的处理[3]。同时变压器故障时常发生,电力变压器结构复杂,不同类型的变压器运维方式存在差异,故变压器运维对技术人员专业能力要求较高且难度较大。当前电力系统中积累了大量的故障处理案例[4],主要为非结构化与半结构化的文本,如何从海量的数据中快速、准确地提取出有价值的信息,使用“知识-数据”联合驱动的方式进行变压器智能运维,是目前电力领域迫切需要解决的问题[5]。

知识图谱的概念在2012年由谷歌正式提出,其本质上是实体关系的语义网络,目前被用来泛指大规模的数据库[6]。在其他领域智能决策、设备运维中知识图谱的研究开展较早,目前已有初步应用。文献[7]构建了紧急事件处理领域辅助决策知识图谱,并使用graphDB数据库对三元组进行存储,实现了应急决策的智能服务。文献[8]以航空系统为例,构建了基于飞机系统运维知识图谱的专家系统,阐述了将知识图谱与航空系统运维相结合的运维方法具有较大优势。文献[9]构建了盾构掘进机运维知识图谱,相较于传统工程师定期维护耗时长、人力需求大等情况,应用知识图谱可使运维更加高效智能,并验证了此方法的可行性与有效性。当前,在电力设备运维领域鲜有知识图谱参与,故将知识图谱与电力变压器智能运维相结合具有广阔的应用前景与较高的使用价值。

目前,知识图谱的研究在电力系统领域中已经有了一定的进展[10],但在电力变压器运维领域尚属起步阶段。文献[11]阐述了知识图谱在电力领域的应用前景,并分析了知识图谱在应用过程中需要解决的问题。文献[12]提出了基于双向循环机制和注意力机制的长短期记忆(Attention-based Bidirectional Long Short Term Memory Networks for relation classification, BiLSTM-Attention)算法的电力设备缺陷实体识别方法,但并未对电力设备知识图谱的构建方法做进一步阐述。文献[13]采用局部感知域卷积神经网络(Local-aware Region Convolutional Neutral Network, LR-CNN)算法进行电网故障处置预案的实体抽取,并基于BiGRU-Attention进行关系抽取,进而构建了电网故障处置知识图谱。但在电力变压器运维领域,公开的可获取的运维文档及事故处理报告等文本数量较少,不足以支撑传统的深度学习模型训练,且标注海量的训练数据存在耗费时间长、成本高等问题,故将传统的深度学习算法应用在电力变压器运维知识图谱构建领域难以取得很好的效果。

BERT(bidirectional encoder representations from transformers)是Google于2018 年提出的预训练模型[14],其已在多个自然语言任务中取得理想效果,但BERT的参数量达到百万级别,需要庞大的算力进行支撑,故本文使用轻量级BERT模型(A Lite BERT, ALBERT)[15],该模型相较于BERT,减少了参数数量以及模型训练占用的资源和时间,能够有效避免传统深度学习方法需要构建大量训练数据的问题,同时由于ALBERT模型中的编码层可以更好地获取文本在语境中的特征信息,生成动态词向量,故可以高效地应对电力变压器运维文本中专有名词多、汉字间包含字母以及符号等问题。

据此,本文提出了基于ALBERT的电力变压器运维知识图谱构建方法。首先以变压器检修导则为指导[16],结合专家意见对变压器运维相关的实体及关系进行分类,构建出知识图谱的本体层。其次基于Selenium框架获取公开的电力变压器运维文献,同时使用正则匹配的方法对非结构化运维文档进行样本生成,接着对文本信息进行标注从而构建电力变压器运维数据集。然后使用ALBERT-BiLSTM-条件随机场(Conditional Random Field, CRF)算法抽取实体信息,采用ALBERT-BiLSTM-Attention算法进行关系抽取,从而获得变压器运维实体三元组。最后,利用Neo4j图数据库进行三元组的存储以及可视化展示,同时基于电力变压器运维知识图谱实现了运维辅助决策功能。

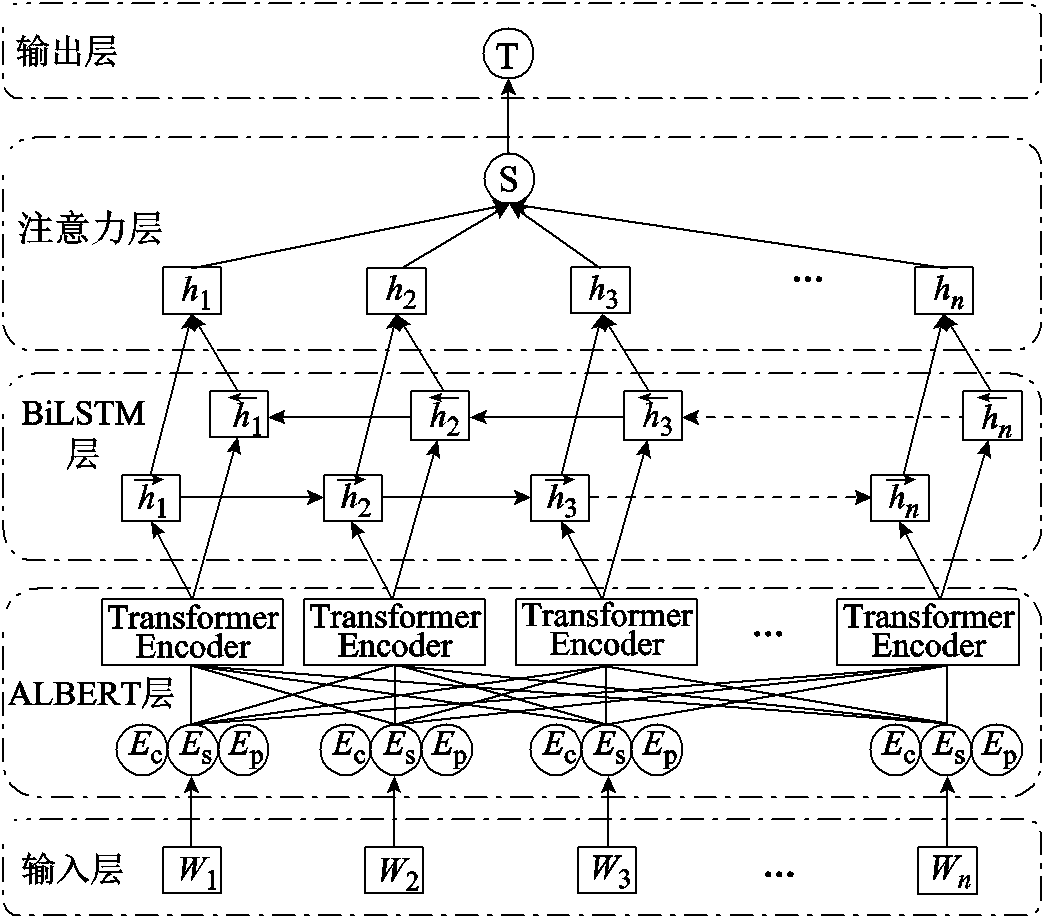

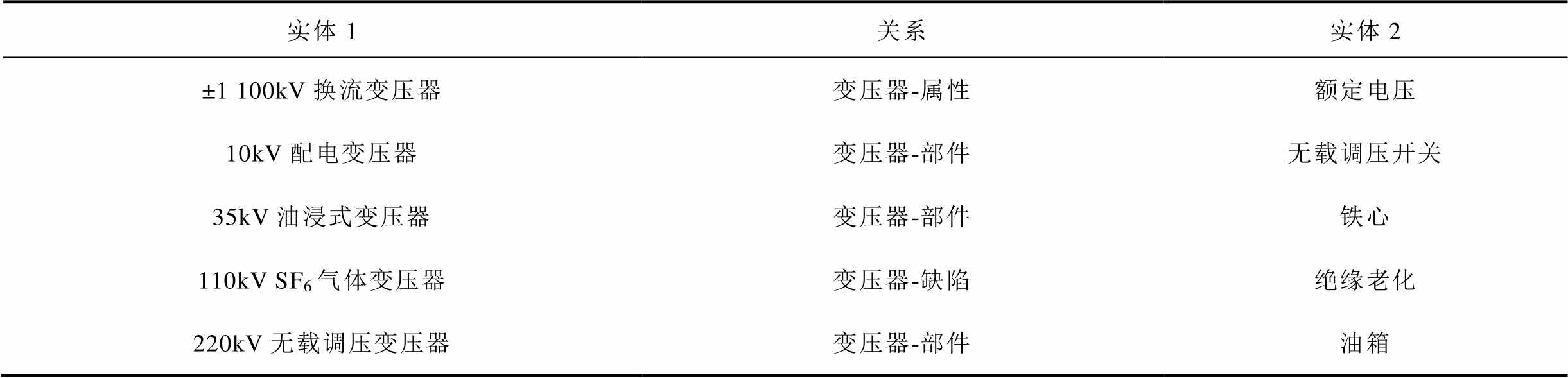

电力变压器运维知识图谱是面向电力变压器进行例行检修、故障运维时的知识检索、故障信息查询以及辅助决策等场景的知识图谱,主要由本体层、实体层、关系和属性构成[17]。

通常知识图谱结构可分为模式层和数据层,模式层又称本体层,是实体及关系的描述框架[18]。数据层又称实体层,用来存储本体层所对应的实体及关系信息,模式层和数据层中数据均以“实体-关系-实体”的形式进行存储[19]。由于变压器运维文本专业性较强,需在电力领域专家的指导下对语料进行深入分析,提炼文本语料的实体信息及其相互关系,构建出本体层。知识图谱实体层主要来源于电力变压器运行、检修和日常管理中所产生的大量非结构化、半结构化的文本数据,利用自然语言处理技术对文本进行实体抽取,再填充进构建的本体当中[20]。实体属性可在图谱构建完成后及使用过程中进行填充和更新,其中包含电力变压器生产厂商、试验方法、缺陷名称、基本参数等信息。电力变压器运维知识图谱结构示意图如图1所示。

知识图谱构建方法主要包括由知识驱动的自顶向下(top-down)式、由数据驱动的自底向上(bottom-up)式以及两者的组合方式[21]。本文采用自顶向下与自底向上两者相结合的方式进行构建,即在最初阶段定义好本体概念及它们相互之间的关系,在进行实体及关系抽取的同时对模式层进行调整与完善。

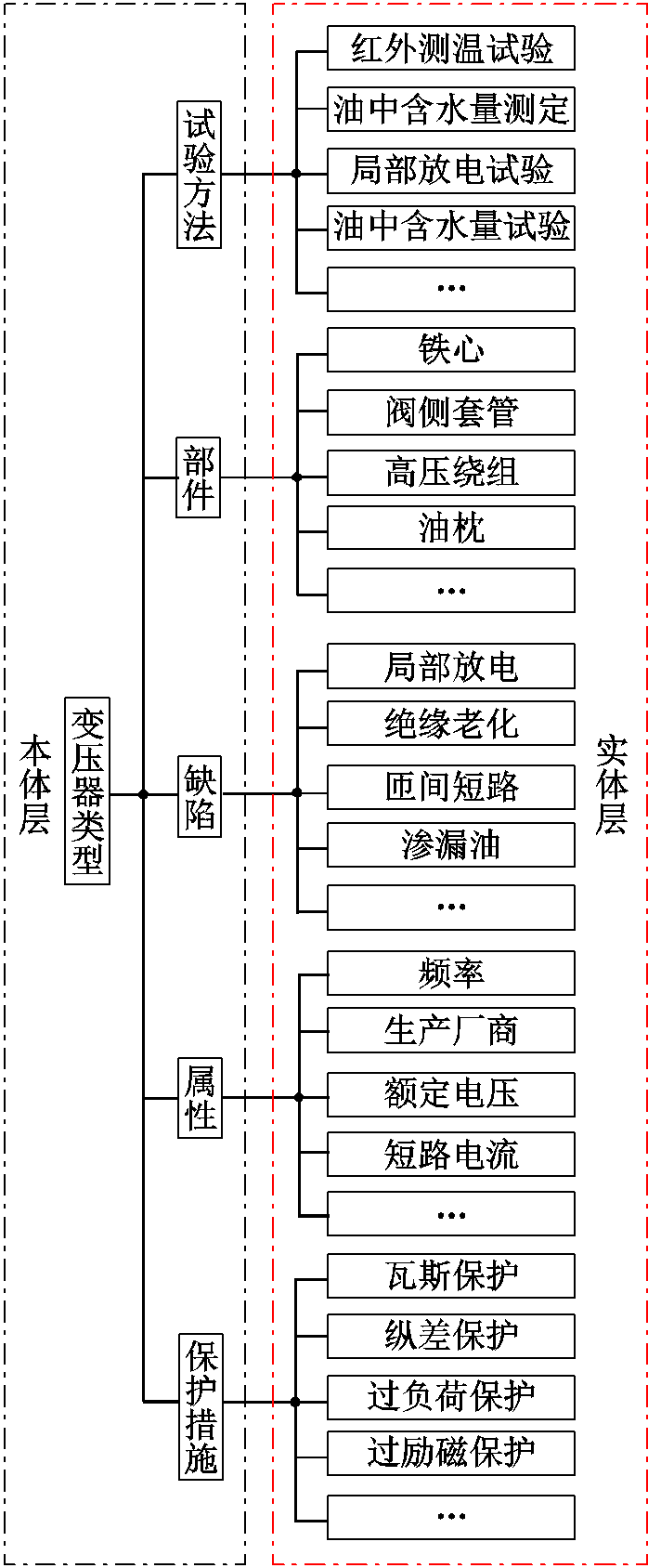

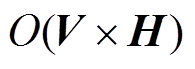

本文在电力领域专家的指导下,对语料文本信息进行提炼,形成了包含变压器型号、部件、缺陷、属性、试验方法、保护措施等本体概念及它们之间的相互关系,构建出本体层。电力变压器运维知识图谱实体层构建主要在本体层概念的基础上进行实体抽取、关系抽取、属性抽取等[22]。首先对非结构化文本进行数据标注构成训练数据集,同时对半结构化变压器故障报告进行样本生成从而扩充语料数目,接着使用深度学习算法对电力变压器运维文本进行实体及关系抽取,构建出三元组并存入图数据库中,从而完成知识图谱的构建。

图1 变压器运维知识图谱结构示意图

Fig.1 Schematic diagram of transformer operation and maintenance knowledge graph structure

在知识图谱构建完成之后,考虑到构建图谱过程中所使用的数据来源和质量的不同,在进行信息抽取过程中可能会出现部分信息错误或冗余,故需要进行知识融合。其中实体对齐是将采用不同表达方式的同一实体进行合并,如“局部放电”和“局放”表达意思一致,可用同一实体表示。实体消歧是将相同名称表示的不同实体进行区分,如运维文本中“1号母线”的意义可表示“1号主变的1号母线”也可表示“2号主变的1号母线”,故需要对两者中的“1号母线”进行区分。在日常电力变压器运维过程中,若遇见新的知识或者发现图谱内存在信息缺失、错误等情况,需及时对图谱进行知识补全,提升图谱质量。本文最终构建的知识图谱包含6类本体, 5 545个实体以及5类本体关系,3 529个实体关系。电力变压器运维知识图谱构建方法示意图如图2所示。

在2018年,J. Devlin等[14]提出了BERT预训练模型,该模型能很好地解决包括字词的上下文表示、表征字词的多样性等句法特征问题。BERT 使用双 Transformer 作为编码器来融合文本上下文的信息以及前文本和后文本信息。对于一个短语,其输入表示可以通过将令牌嵌入(token embeddings)、段落嵌入(segment embeddings)和位置嵌入(position embeddings)的三个部分相加来组成。Transformer基于注意力机制对文本进行建模,注意力机制为

(1)

(1)

在式中,Q、K和V为输入词向量矩阵;dk为输入向量维度。由公式可以看出不同词之间有着相互联系,且在一定程度上反映了句子中不同词之间具有相互各异的重要程度,即每个字向量都含有当前句子内所有字向量的信息。

图2 电力变压器运维知识图谱构建方法示意图

Fig.2 Schematic diagram of power transformer operation and maintenance knowledge graph construction method

为了减小BERT预训练模型占用空间大的缺点,2020年Z. Lan 等[15]提出了ALBERT轻量级预训练模型,该模型将BERT进行简化,使用分解式嵌入参数化、跨层参数共享等方法来有效地减少计算参数并加快模型训练的速度。在ALBERT中,分解式嵌入参数化用于减少参数数量,即对词嵌入参数进行因式分解,将其分解为两个小矩阵。大小为V的词表不再将其one-hot向量直接映射到大小为H的隐藏空间,而是先将它们映射到一个低维词嵌入空间E,然后再映射到隐藏空间,即参数个数由 变为

变为 。当H远大于E时,参数减少的数量会很明显。同时,ALBERT采用了Transformer共享完整连接层和Attention层的解决方案,即共享隐藏层中的所有参数,并且相同大小的Transformer在采用此解决方案后,参数数量大幅减少,训练速度得到明显提高。

。当H远大于E时,参数减少的数量会很明显。同时,ALBERT采用了Transformer共享完整连接层和Attention层的解决方案,即共享隐藏层中的所有参数,并且相同大小的Transformer在采用此解决方案后,参数数量大幅减少,训练速度得到明显提高。

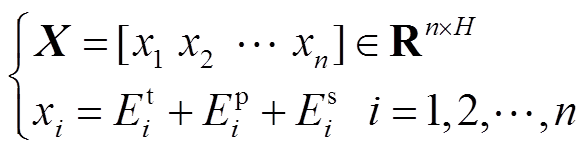

本文使用ALBERT-BiLSTM-CRF模型进行实体抽取,其结构示意图如图3所示。首先原始输入语句经过输入层后变为字序列 进入到ALBERT层,该层首先会将字序列转换成输入神经网络的向量序列X,X为

进入到ALBERT层,该层首先会将字序列转换成输入神经网络的向量序列X,X为

(2)

(2)

在式中,H为向量维度; 为对字序列进行字嵌入编码;

为对字序列进行字嵌入编码;![]() 为对字序列进行位置信息编码;

为对字序列进行位置信息编码; 为对字序列进行语句信息编码,将以上三者映射到高维度相加得到ALBERT层的输入序列X[23]。

为对字序列进行语句信息编码,将以上三者映射到高维度相加得到ALBERT层的输入序列X[23]。

图3 ALBERT-BiLSTM-CRF模型

Fig.3 ALBERT-BiLSTM-CRF model

接着序列X通过计算多层Transformer的完整特征来获得最终的特征向量T。然后特征向量T输入至BiLSTM层,该层可捕获文字基于上下文信息的语言特征,输出考虑上下文信息的向量序列 ,接着将向量序列O输入至CRF层,根据相邻标签关系最终获得全局最佳标签序列,即可输出最优实体标签[24]。

,接着将向量序列O输入至CRF层,根据相邻标签关系最终获得全局最佳标签序列,即可输出最优实体标签[24]。

关系抽取(Relation Extraction, RE)是知识抽取的核心任务之一,其目的是对句子中实体间的关系进行识别,关系抽取是构建变压器运维知识图谱与智能运维问答系统等下游任务的基础[25]。

电力变压器运维实体关系抽取同样基于ALBERT预训练模型,并且在BiLSTM的基础上引入Attention注意力机制。该机制有助于给关系分类中的关键信息加大权重,减少干扰无义信息的权重,从而进一步提高模型特征抽取的准确性,并且可对BiLSTM预测的状态信息序列进行加权变换,自动按信息的重要程度赋予不同的权重。ALBERT-BiLSTM-Attention模型如图4所示。

图4 ALBERT-BiLSTM-Attention模型

Fig.4 ALBERT-BiLSTM-Attention model

电力变压器运维领域中公开的运维文档与事故处理报告较少,即可用于模型训练的语料较少,故需构建用于电力变压器领域的训练数据集。本文的数据集中包含基于Selenium框架获取的关键词中含有“电力变压器运维”的公开文本等非结构化文本,以及变压器现场故障分析报告、异常检测报告等半结构化文本,其中变压器相关的技术文献800余篇,变压器运维检修事故报告200余篇,共约80余万字。内容包括变压器故障诊断方法、变压器故障运维方案等,涵盖了电力变压器领域绝大部分的故障类型、故障诊断方法以及热点研究内容。

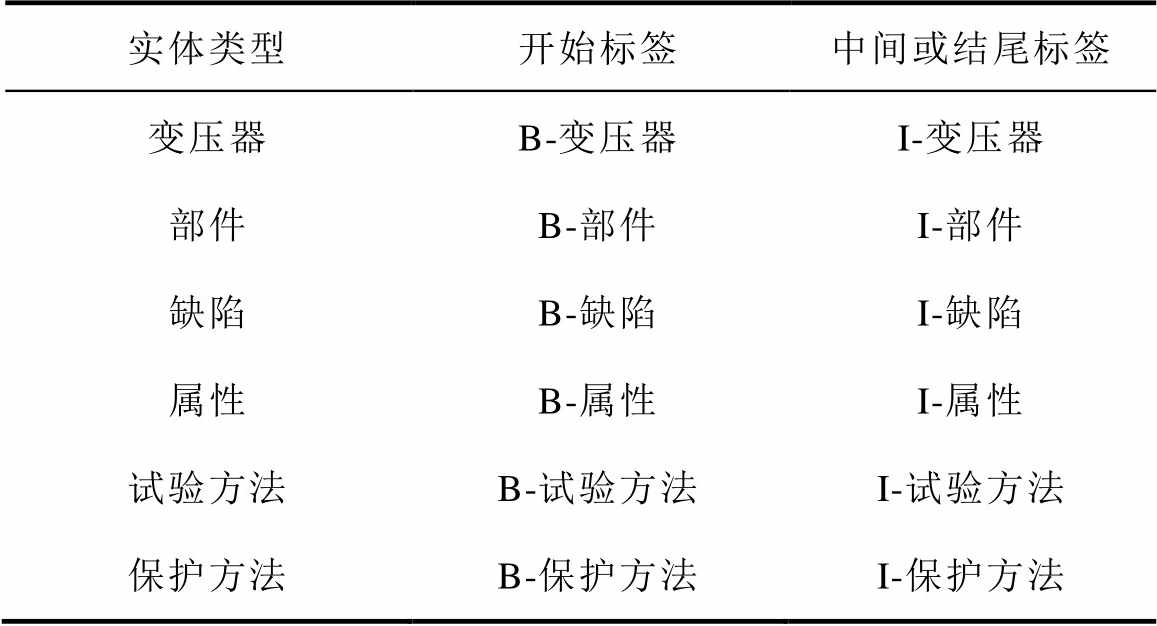

数据集构建过程分为两部分:第一部分是对获取的故障分析报告、异常检测报告等文本基于正则匹配规则的方法进行样本生成;第二部分是对获取的文献文本进行数据清洗,接着对处理后的文本进行标注。本文采取的标准策略为BIO标注,每个字符标注以“B”、“I”或者“O”开头[26],当头尾及中间实体标签全部预测正确时,才判断该实体预测正确。六类实体的待预测标签见表1。

表1 实体待预测标签

Tab.1 Labels of the entity to be predicted

实体类型开始标签中间或结尾标签 变压器B-变压器I-变压器 部件B-部件I-部件 缺陷B-缺陷I-缺陷 属性B-属性I-属性 试验方法B-试验方法I-试验方法 保护方法B-保护方法I-保护方法

由于电力变压器运维属于专业领域,运维文档和异常检测报告等语料获取途径以及数量有限,不足以支撑深度学习的模型训练,故电力变压器运维数据集构建的第一部分是对所获取的事故报告进行样本生成,从而扩充语料库规模。首先需要进行词典准备,其中包含变电站名称、变压器型号、部件生产厂商、故障名称、部件属性等信息共计150余条变压器运维领域专业信息,电力变压器运维词典部分内容见表2。

在电力变压器运维词典准备完成后,本文采用基于正则表达式匹配和词典替换的方法进行样本增强,匹配规则为“(。|!|\?|;)”,该正则表达式用于中文分句的符号标识符,即在此类符号所划定的区间内,基于词典内的各类专业名词短语,对电力变压器运维文档以及异常检测报告中的变电站名称、变压器型号、部件生产厂商、故障名称、部件属性等信息进行匹配转换,并辅以专家经验对生成的报告进行校验,保证了生成文本的科学性与准确性。

表2 电力变压器运维词典(部分)

Tab.2 Dictionary of power transformer operation and maintenance (part)

类别子类词典内容 厂站名称变电站名称220kV郭家屯变电站 220kV苗庄变电站 110kV甸头变电站 部件生产厂商许继电气股份有限公司 南京南瑞科技股份有限公司 北京四方继保自动化股份有限公司 变压器故障电故障铁心多点接地 固体绝缘纸局部放电 绝缘瓷套管闪络 热故障油浸电容式套管过热 分接开关过热 铁心过热 运维措施监测方法振动分析法 红外分析法 频率响应分析法 检修方法绝缘耐压试验 泄露电流试验 直流电阻试验

经过样本增强,将最初获取的40余篇运维文档扩充至200余篇事故分析报告和异常检测报告,丰富了训练数据集的内容,解决了样本数量少的问题,进而提升了模型的泛化能力和鲁棒性。

数据集构建的第二部分是对获取的电力变压器相关的公开文本进行数据清洗及文本标注。由于语料中包含互联网中的非结构化文本,故包含一定的噪声,为了提升算法训练质量以及最终所构建知识图谱的可靠性,需对文本进行数据清洗,即删除当中无用的字符,包括换行符、空格等,然后对文本内容进行BIO标注。

文本内容实例如下:“±800kV换流变压器干式套管设计方案,特高压套管的电场分布不均匀:套管头部、电容芯子内部及套管尾部的电场较为集中。均压球内部、油箱底部及远离套管空间中的电场均较低,…,高场强主要集中在芯子极板区域内部,保护层中的电场强度较低,但电磁暂态仿真表明极板边缘区域电场强度较高,极板边缘易于产生局部放电,长期烧蚀可出现炭化痕迹,最终导致套管芯子的内部绝缘击穿。”其对应的标注文件格式为ann格式文件,内容见表3。通过读取ann文件将实体类型与实体文字相匹配,从而实现对训练集的标注,标注后的数据格式见表4。

表3 ann标注文件示例

Tab.3 ann annotation file example

实体编号实体类别起始字符编号结束字符编号实体名称 T1变压器600611±800kV换流变压器 T2部件620624干式套管 T3部件724726油箱 T4试验方法13441350电磁暂态仿真 T5部件13931397套管芯子 T6缺陷14011405绝缘击穿

表4 实体标注结果

Tab.4 Entity labeling results

文本数据标注数据 特B-部件 高I-部件 压I-部件 套I-部件 管I-部件 的O 电O 压O

本文的实验环境为:Win10操作系统,处理器为Intel(R)Core(TM)i5-6360U CPU,16GB内存,显卡为Tesla T4 GPU,编程平台为PyCharm,编程环境是Python3.6。

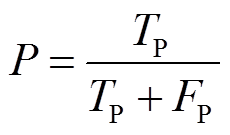

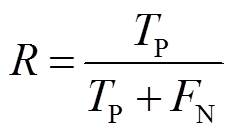

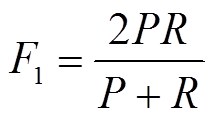

实体识别的评价指标有准确率P、召回率R和F1分数值,其中 分数作为实体识别模型的综合评价指标,说明实体识别模型的整体性能。评价指标计算公式为

分数作为实体识别模型的综合评价指标,说明实体识别模型的整体性能。评价指标计算公式为

(3)

(3)

(4)

(4)

(5)

(5)

式中,TP、FP、FN为混淆矩阵(confusion matrix)中的元素。TP指被正确预测的正例, FP指真实值为反例被错误预测为正例,FN指真实值为正例被错误预测为反例。

模型训练前,需要对模型进行参数设置,ALBERT-BiLSTM-CRF模型训练参数见表5。

表5 ALBERT-BiLSTM-CRF模型训练参数

Tab.5 ALBERT-BiLSTM-CRF model training parameter

参数数值 batch size64 learning rate0.000 1 epochs20 max length256 hidden size192

为了验证对于电力变压器运维,本文采用ALBERT-BiLSTM-CRF算法进行实体抽取的优越性,将此算法与BiLSTM和BiLSTM-CRF算法进行对比,实验结果分别见表6和图5所示。

表6 实体抽取算法结果对比

Tab.6 Comparison of results of entity extraction algorithms

模型名称准确率P召回率RF1分数 BiLSTM0.8140.8790.845 BiLSTM-CRF0.8530.8740.863 ALBERT-BiLSTM-CRF0.9440.9410.942

图5 算法F1分数对比图

Fig.5 Comparison graph of algorithm F1 score

本文基于ALBERT-BiLSTM-CRF算法从电力变压器语料中抽取出5 545个实体,从实验结果可以看出,基于该实体抽取算法的识别评价结果高于其他两种方法,这是由于ALBERT预训练模型不仅可以获取到包含上下文信息的词级特征,还能有效捕捉句子级别的特征,并且能够基于上下文生成动态词向量,能有效解决变压器运维文本一词多义问题。

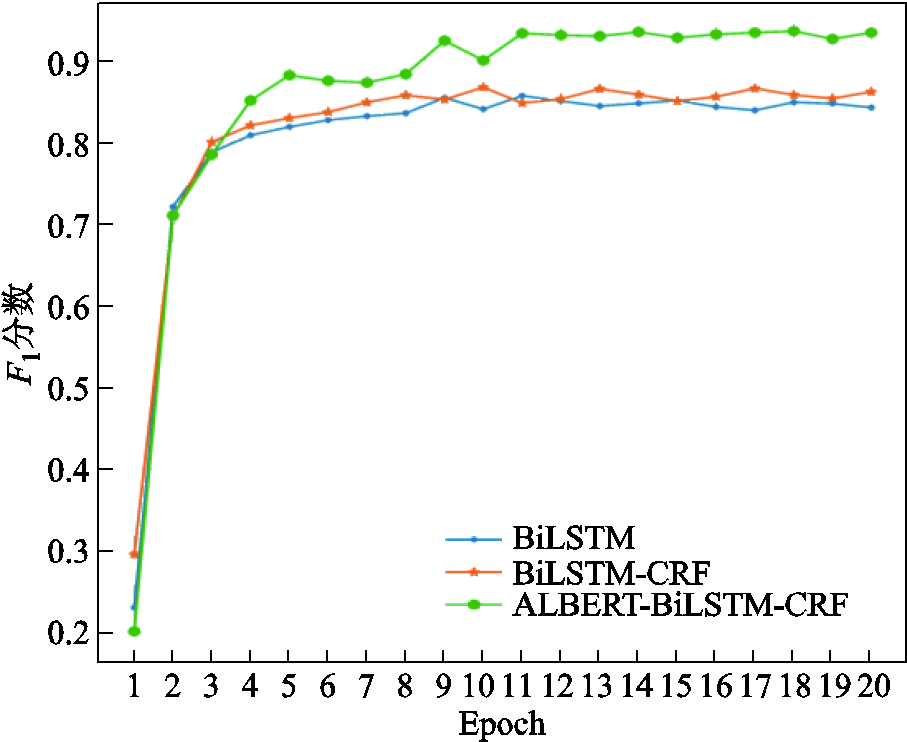

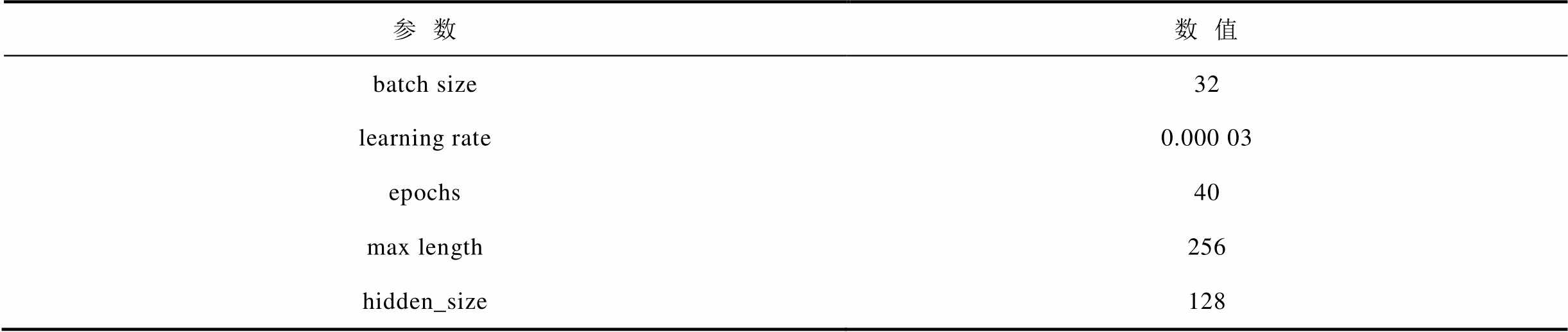

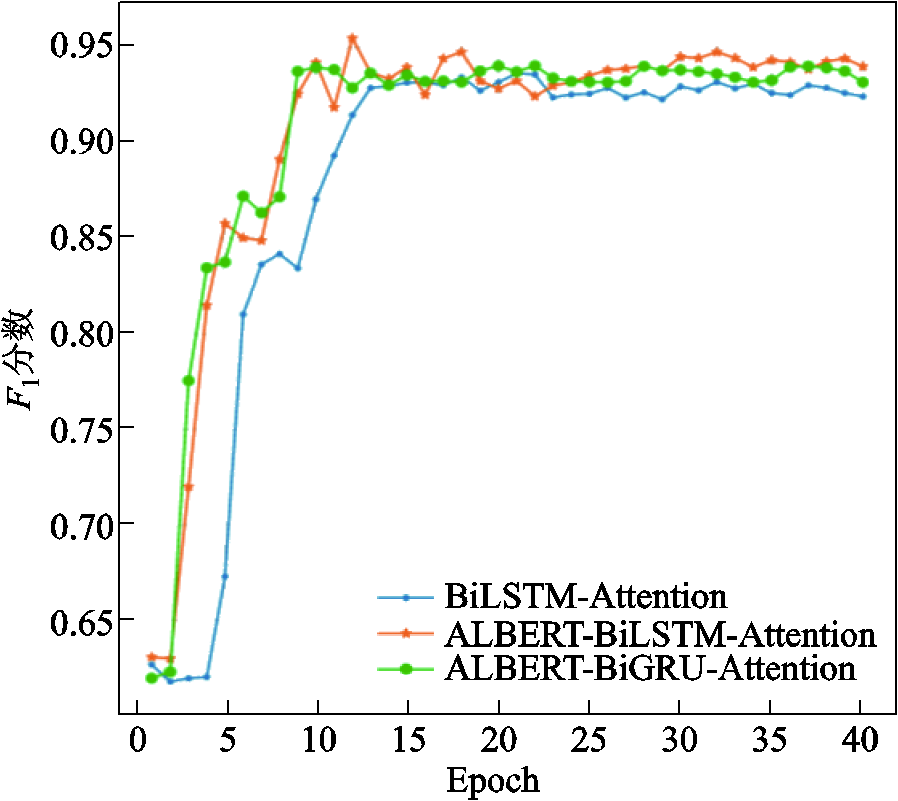

实验评测采用与实体抽取一致的评价指标:准确率P、召回率R和F1值。模型参数设置见表7,关系抽取结果对比见表8,三种深度学习模型关系抽取过程中F1分数如图6所示。

表7 ALBERT-BiLSTM-Attention模型训练参数

Tab.7 ALBERT-BiLSTM-Attention model training parameter

参数数值 batch size32 learning rate0.000 03 epochs40 max length256 hidden_size128

表8 关系抽取算法结果对比

Tab.8 Comparison of results of relation extraction algorithms

模型名称准确率P召回率RF1分数 BiLSTM-Attention0.9190.9390.926 ALBERT-BiGRU-Attention0.9250.9470.935 ALBERT-BiLSTM-Attention0.9410.9620.951

图6 关系抽取模型训练模曲线

Fig.6 Relation extraction model training curves

从表8以及图6可以看出,ALBERT预训练模型在电力变压器运维领域文本的关系抽取任务中有明显的优势,相较于BiLSTM-Attention,ALBERT-BiLSTM-Attention模型F1分数由0.926提升至0.951,且融入了注意力机制,可对文本中更重要的字赋予权重以提高重要性,从而提升关系抽取的准确率。本文基于ALBERT-BiLSTM-Attention模型从语料中共抽取出3 529个实体间关系,且该模型关系抽取的F1值达到0.951,可准确地识别实体间的关系。

本文使用pipeline式的知识抽取方法分别进行实体和关系抽取,同时考虑到训练语料为电力变压器运维相关的专业领域文本,语言较为精炼、专业性较强,而ALBERT预训练模型具有强大的特征抽取能力,且BiLSTM模型能够很好地捕获上下文信息,同时在实体抽取算法最后加入CRF层可以自动学习到实体标签的约束,从而保证最终预测结果的有效性;在关系抽取中融入Attention机制,可以给信息按照重要程度加上不同的权重,从而提升关系抽取的准确率。故采用ALBERT-BiLSTM-CRF算法进行实体抽取,使用ALBERT-BiLSTM- Attention算法进行关系抽取,通过对比实验可以看出,采用这两种算法分别进行实体和关系抽取,相较于传统的深度学习算法有着明显优势。

Neo4j 是一个性能卓越的非关系型图数据库,其使用的 Cypher语言是一种专属 Neo4j 的声明式查询语言[27]。Neo4j的数据主要由节点、边、属性构成,其中它的顶点和边都可以构建属性值,并且具有高可用性和高扩展性。

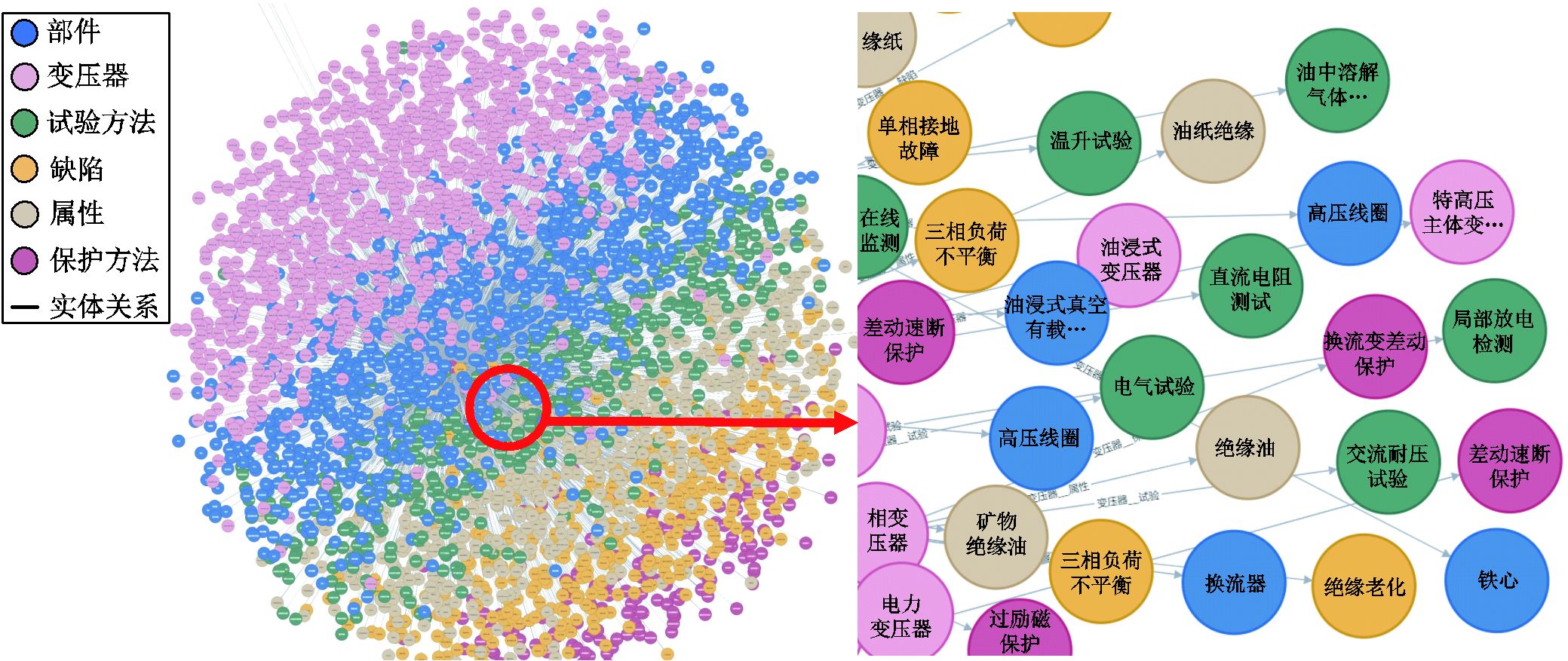

本文基于构建的电力变压器运维数据集共抽取了5 545个电力变压器运维领域实体和3 529个实体间关系,在知识抽取完成后,根据关系的主体和客体进行链接,即形成如表9所示的〈实体1,关系,实体2〉三元组。

表9 电力变压器运维三元组示例

Tab.9 Examples of power transformer operation and maintenance triplet

实体1关系实体2 ±1 100kV换流变压器变压器-属性额定电压 10kV配电变压器变压器-部件无载调压开关 35kV油浸式变压器变压器-部件铁心 110kV SF6气体变压器变压器-缺陷绝缘老化 220kV无载调压变压器变压器-部件油箱

将实体关系三元组存储为CSV文件格式导入Neo4j数据库,基于该数据库绘制出的电力变压器运维知识图谱全貌如图7所示。其中,每个颜色代表一类电力变压器运维实体,每个节点代表实体内容,实体之间连线表示二者之间存在的实体关系。

图7 电力变压器运维知识图谱

Fig.7 Knowledge graph of power transformer operation and maintenance

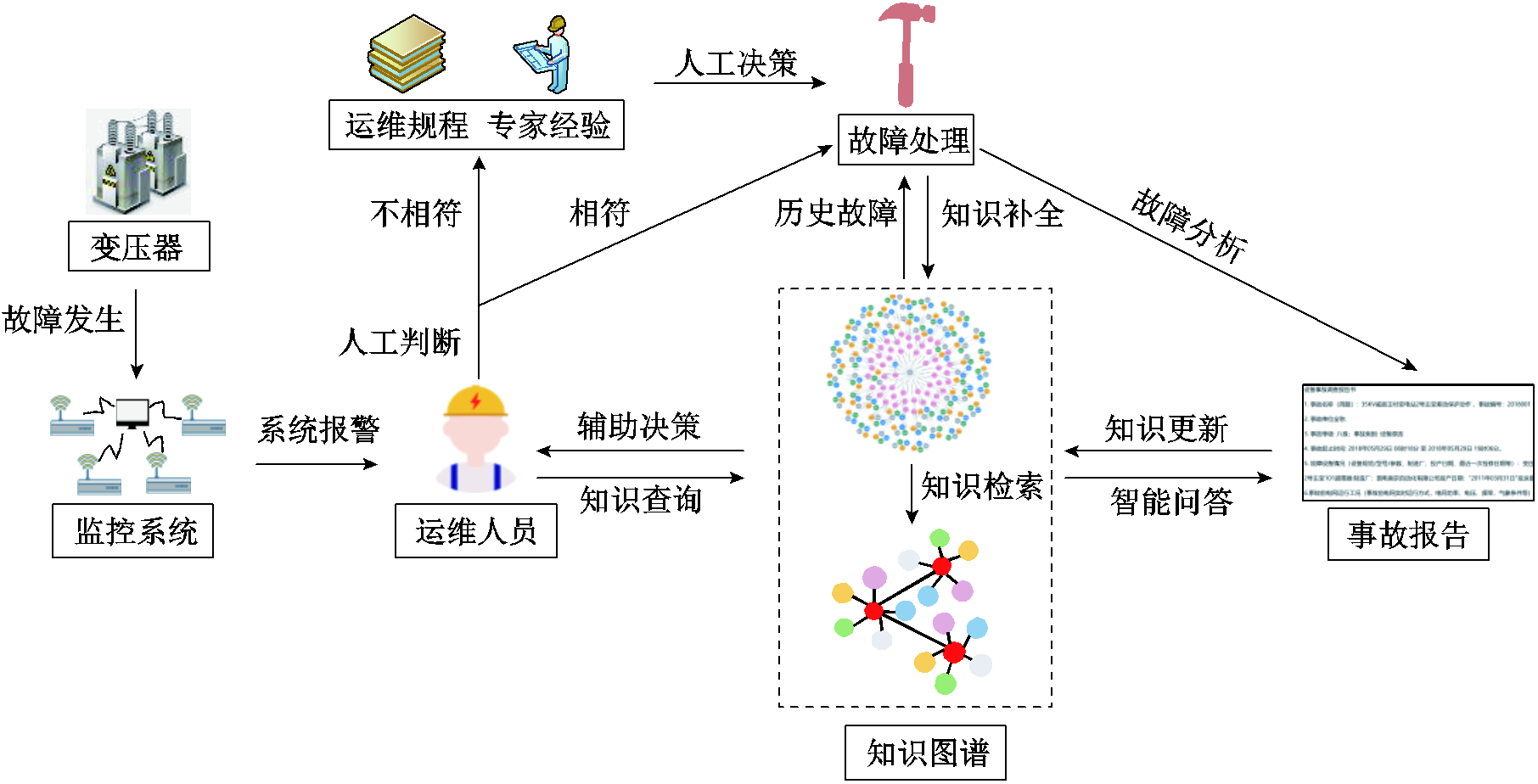

目前,变压器故障诊断及运维过程中所使用的神经网络依赖大量样本进行训练,输出的结果缺乏可解释性,而融合知识图谱的知识推理与深度问答过程依赖的是知识本身的关联关系,使得生成的辅助决策信息具有更高的可解释性。在电力变压器运维领域,知识图谱可以参与运维问答、辅助决策等多种智能运维场景。将推理结果辅以人工经验及运维规程等信息加以规范,最终形成具有高可信度的运维决策建议,对电力变压器运维有较强的指导意义。电力变压器运维知识图谱应用示意图如图8所示,融入知识图谱后,传统的以经验为基础的运维模式转变为“知识-数据”驱动的智能运维模式,大幅地提升了电力变压器的健康管理水平。

图8 电力变压器运维知识图谱应用示意图

Fig.8 Schematic diagram of application of power transformer operation and maintenance knowledge graph

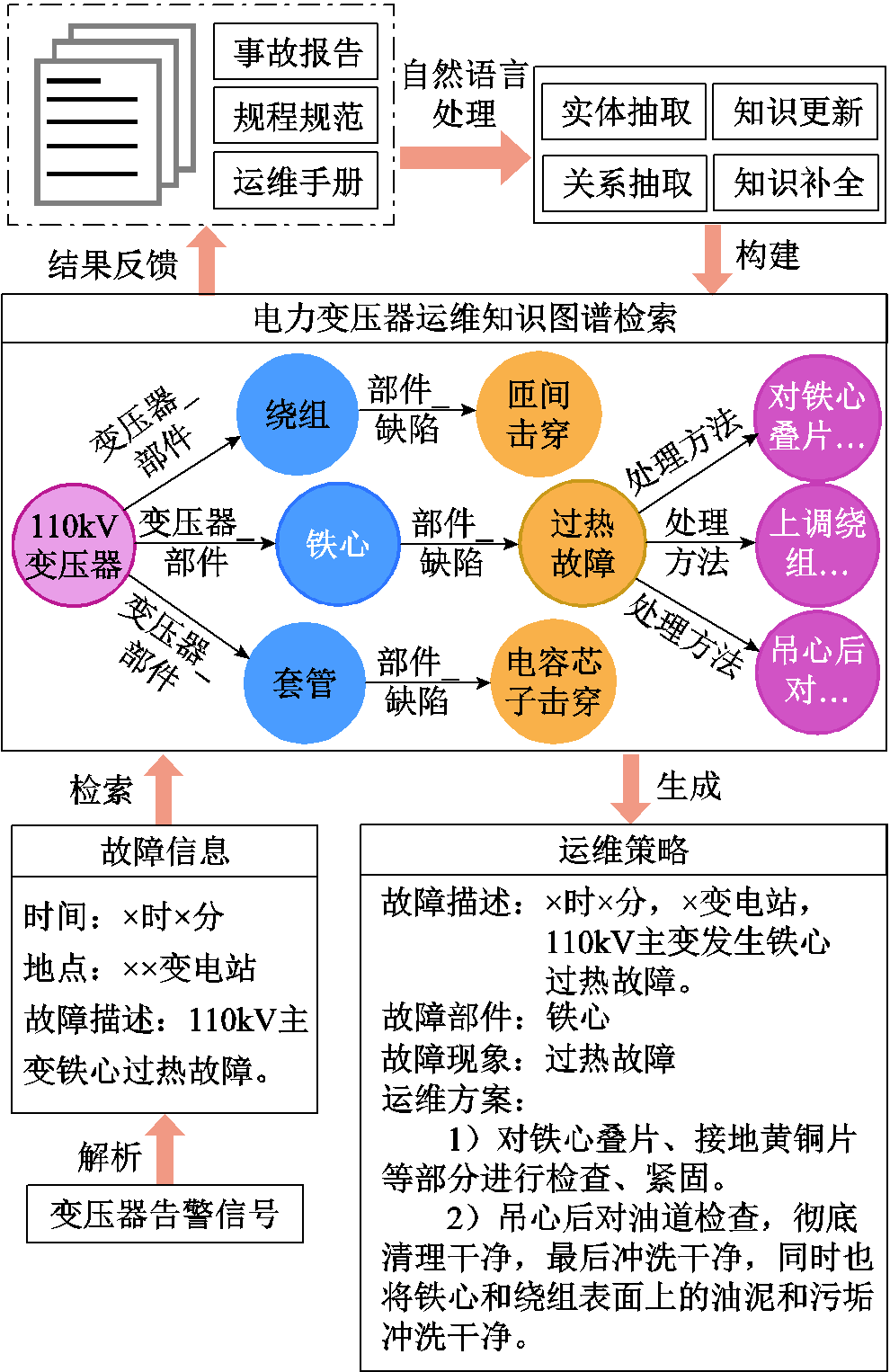

基于构建的电力变压器运维知识图谱本文实现了辅助决策的功能,如图9所示,根据电力变压器运维图谱中的故障发生地点及故障描述等相关信息,提取故障变压器的型号及部件等关键信息,并将这些信息与图谱内的海量知识进行匹配筛选,从而获得相关设备部件的规范运维方案并生成故障处理报告,进而实现辅助决策的功能。

本文以“X时X分XX变电站110kV主变压器铁心过热故障”为例,通过故障信息解析,得到故障发生的时间、地点以及故障设备为“110kV电力变压器”,发生的故障为“铁心过热故障”,运维人员通过例如“110kV变压器铁心过热故障处理方法是什么?”的问题对运维方案进行查询,输入语句经过分词工具分为“110kV变压器”“铁心”“过热故障”“处理方法”等字段,对实体内容在运维图谱里进行匹配,并以“处理方法”为实体关系对该故障对应的运维方法进行检索与提取,从而实现电力变压器故障的辅助决策并自动生成故障运维报告。同时,结合相应的故障诊断方法,运维人员对处理决策核验与完善,即将图谱知识与专家经验相结合对变压器进行运维,进而提升运维准确率和效率,并且新生成的运维报告可对图谱更新提供支撑,有助于提升知识图谱的规模和质量。再者,基于变压器运维知识图谱可进一步对可能发生相关故障的部件进行推理,达到对类似部件进行统一维护的目的,从而降低同类型部件故障的发生概率。

图9 基于电力变压器运维知识图谱应用实例

Fig.9 Application example of knowledge graph for power transformer operation and maintenance

本文基于电力变压器运维相关文献以及故障检修报告等文本语料,提出了一种基于ALBERT的电力变压器知识图谱构建方法,主要结论如下:

1)提出了电力变压器运维知识图谱构建思路,构建出知识图谱本体层,包含变压器型号、部件、缺陷、属性、试验方法、保护措施六类本体。针对电力变压器运维领域文本数量少的问题,利用公开文献以及变压器运维报告等语料信息,自主构建了电力变压器领域训练数据集。

2)基于ALBERT-BiLSTM-CRF的深度学习算法实现了变压器运维实体识别,F1分数可达0.942,并通过对比试验验证了此算法的优越性。

3)采用融合注意力机制的ALBERT-BiLSTM- Attention算法抽取了变压器运维实体关系,并与其他两个深度学习关系抽取算法进行对比实验,此算法F1分数达到0.951,较好地实现了电力变压器运维领域实体间关系抽取任务。

4)将5 545个实体及3 529个实体关系存储至Neo4j数据库构建出变压器运维知识图谱并实现可视化,同时实现了基于电力变压器运维知识图谱的辅助决策功能。

参考文献

[1] 李刚, 李银强, 王洪涛, 等. 电力设备健康管理知识图谱:基本概念、关键技术及研究进展[J]. 电力系统自动化, 2022, 46(3): 1-13.

Li Gang, Li Yinqiang, Wang Hongtao, et al. Knowledge graph of power equipment health management: basic concepts, key technologies and research progress[J]. Automation of Electric Power Systems, 2022, 46(3): 1-13.

[2] 谢庆, 杨天驰, 裴少通, 等. 基于多尺度协作模型的电气设备红外图像超分辨率故障辨识方法[J]. 电工技术学报, 2021, 36(21): 4608-4616.

Xie Qing, Yang Tianchi, Pei Shaotong, et al. Super-resolution identification method of electrical equipment fault based on multi-scale cooperation model[J]. Transactions of China Electrotechnical Society, 2021, 36(21): 4608-4616.

[3] 赵鹏, 蒲天骄, 王新迎, 等. 面向能源互联网数字孪生的电力物联网关键技术及展望[J]. 中国电机工程学报, 2022, 42(2): 447-457.

Zhao Peng, Pu Tianjiao, Wang Xinying, et al. Key technologies and perspectives of power Internet of Things facing with digital twins of the energy Internet[J]. Proceedings of the CSEE, 2022, 42(2): 447-457.

[4] 律方成, 牛雷雷, 王胜辉, 等. 基于优化YOLOv4的主要电气设备智能检测及调参策略[J]. 电工技术学报, 2021, 36(22): 4837-4848.

Lü Fangcheng, Niu Leilei, Wang Shenghui, et al. Intelligent detection and parameter adjustment strategy of major electrical equipment based on optimized YOLOv4[J]. Transactions of China Electrotechnical Society, 2021, 36(22): 4837-4848.

[5] 蒋逸雯, 李黎, 李智威, 等. 基于深度语义学习的电力变压器运维文本信息挖掘方法[J]. 中国电机工程学报, 2019, 39(14): 4162-4171.

Jiang Yiwen, Li Li, Li Zhiwei, et al. An information mining method of power transformer operation and maintenance texts based on deep semantic learning[J]. Proceedings of the CSEE, 2019, 39(14): 4162-4171.

[6] 刘梓权, 王慧芳. 基于知识图谱技术的电力设备缺陷记录检索方法[J]. 电力系统自动化, 2018, 42(14): 158-164.

Liu Ziquan, Wang Huifang. Retrieval method for defect records of power equipment based on knowledge graph technology[J]. Automation of Electric Power Systems, 2018, 42(14): 158-164.

[7] Chen Jiahui, Ge Xingtong, Li Weichao, et al. Construction of spatiotemporal knowledge graph for emergency decision making[C]//2021 IEEE International Geoscience and Remote Sensing Symposium IGARSS, Brussels, Belgium, 2021: 3920-3923.

[8] Sarazin A, Bascans J, Sciau J B, et al. Expert system dedicated to condition-based maintenance based on a knowledge graph approach: application to an aeronautic system[J]. Expert Systems With Applications, 2021, 186: 115767.

[9] Qin Hao, Jin Jiong. Intelligent maintenance of shield tunelling machine based on knowledge graph[C]// 2020 IEEE 18th International Conference on Industrial Informatics, Warwick, United Kingdom, 2020: 793-797.

[10] 边晓燕, 张璐瑶, 周波, 等. 基于知识图谱的国内外电力市场研究综述[J]. 电工技术学报, 2022, 37(11): 2777-2788.

Bian Xiaoyan, Zhang Luyao, Zhou Bo, et al. Review on domestic and international electricity market research based on knowledge graph[J]. Transactions of China Electrotechnical Society, 2022, 37(11): 2777-2788.

[11] 蒲天骄, 谈元鹏, 彭国政, 等. 电力领域知识图谱的构建与应用[J]. 电网技术, 2021, 45(6): 2080-2091.

Pu Tianjiao, Tan Yuanpeng, Peng Guozheng, et al. Construction and application of knowledge graph in the electric power field[J]. Power System Technology, 2021, 45(6): 2080-2091.

[12] 冯斌, 张又文, 唐昕, 等. 基于BiLSTM-Attention神经网络的电力设备缺陷文本挖掘[J]. 中国电机工程学报, 2020, 40(增刊1): 1-10.

Feng Bin, Zhang Youwen, Tang Xin, et al. Power equipment defect record text mining based on BiLSTM-attention neural network[J]. Proceedings of the CSEE, 2020, 40(S1): 1-10.

[13] 郭榕, 杨群, 刘绍翰, 等. 电网故障处置知识图谱构建研究与应用[J]. 电网技术, 2021, 45(6): 2092-2100.

Guo Rong, Yang Qun, Liu Shaohan, et al. Construction and application of power grid fault handing knowledge graph[J]. Power System Technology, 2021, 45(6): 2092-2100.

[14] Devlin J, Chang Mingwei, Lee K, et al. BERT: pre-training of deep bidirectional transformers for language understanding[J/OL]. https://doi.org/10. 48550/arXiv.1810.04805, 2019,

[15] Lan Z, Chen M, Goodman S, et al. ALBERT: a lite BERT for self-supervised learning of language representations[C]//Proceedings of the 8th International Conference on Learning Representations, La Jolla, CA, 2020: 1-17.

[16] 国家能源局. DL/T 573—2010电力变压器检修导则[S]. 北京: 中国电力出版社, 2010.

[17] Fan Tao, Wang Hao. Research of Chinese intangible cultural heritage knowledge graph construction and attribute value extraction with graph attention network[J]. Information Processing & Management, 2022, 59(1): 102753.

[18] zhang Fan, Wu Jizhou, Nie Yingli, et al. Research of knowledge graph technology and its applications in agricultural information consultation field[C]//2020 IEEE 39th International Performance Computing and Communications Conference, Austin, TX, USA, 2020: 1-4.

[19] Zeng Xiangxiang, Tu Xinqi, Liu Yuansheng, et al. Toward better drug discovery with knowledge graph[J]. Current Opinion in Structural Biology, 2022, 72: 114-126.

[20] Ma Xiaogang. Knowledge graph construction and application in geosciences: a review[J]. Computers & Geosciences, 2022, 161: 105082.

[21] 乔骥, 王新迎, 闵睿, 等. 面向电网调度故障处理的知识图谱框架与关键技术初探[J]. 中国电机工程学报, 2020, 40(18): 5837-5848.

Qiao Ji, Wang Xinying, Min Rui, et al. Framework and key technologies of knowledge-graph-based fault handling system in power grid[J]. Proceedings of the CSEE, 2020, 40(18): 5837-5848.

[22] Ma Lianbo, Wang Jingwei, Cheng Jian, et al. MLRP-KG: mine landslide risk prediction based on knowledge graph[J]. IEEE Transactions on Artificial Intelligence, 2022, 3(1): 78-87.

[23] 叶欣智, 尚磊, 董旭柱, 等. 面向配电网故障处置的知识图谱研究与应用[J]. 电网技术, 2022, 46(10): 3739-3749.

Ye Xinzhi, Shang Lei, Dong Xuzhu, et al. Knowledge graph for distribution network fault handling[J]. Power System Technology, 2022, 46(10): 3739-3749.

[24] 贺瑞芳, 段绍杨. 基于多任务学习的中文事件抽取联合模型[J]. 软件学报, 2019, 30(4): 1015-1030.

He Ruifang, Duan Shaoyang. Joint Chinese event extraction based multi-task learning[J]. Journal of Software, 2019, 30(4): 1015-1030.

[25] 杨穗珠, 刘艳霞, 张凯文, 等. 远程监督关系抽取综述[J]. 计算机学报, 2021, 44(8): 1636-1660.

Yang Suizhu, Liu Yanxia, Zhang Kaiwen, et al. Survey on distantly-supervised relation extraction[J]. Chinese Journal of Computers, 2021, 44(8): 1636-1660.

[26] 蔡莉, 王淑婷, 刘俊晖, 等. 数据标注研究综述[J]. 软件学报, 2020, 31(2): 302-320.

Cai Li, Wang Shuting, Liu Junhui, et al. Survey of data annotation[J]. Journal of Software, 2020, 31(2): 302-320.

[27] Li Chun xin, Lu Qian nan, Huang Ming, et al. Construction of radio transmission equipment type approval knowledge graph and its application[C]// 2021 IEEE 2nd International Conference on Big Data, Artificial Intelligence and Internet of Things Engineering, Nanchang, China, 2021: 956-961.

Abstract Knowledge graph can effectively manage massive information and deal with complex and diverse relationships. At the same time, knowledge search and decision-making based on knowledge graph are more in line with human logic and enhance the interpretability of answers. Since the current power transformer operations mainly depends on traditional experience, and has accumulated the massive operations within the power system documentation and the accident report, it is an urgent need to solve the problem on how to read the vast amounts of data quickly and accurately extract the valuable information, so as to use data-driven approach to transformer intelligent operations. Therefore, this paper proposes an ALBERT based knowledge graph construction method for power transformer operation and maintenance.

First of all, due to the small number of publicly available operation and maintenance documents and accident handling reports in the field of power transformer operation and maintenance, it is necessary to build a training dataset for the field of power transformer. The construction process of the dataset is divided into two parts. The first part is to generate samples of the obtained fault analysis report, anomaly detection report and other texts on basis of the method of regular matching rules. The second part is to clean the obtained literature texts and annotate the processed texts with BIO method. Then, the ALBERT-BiLSTM-CRF model was used to extract entities from the operation and maintenance texts of power transformers, and the ALBERT-BiLSTM-Attention model is used to extract relations from the operation and maintenance texts of power transformers. Finally, the Neo4j graph database is used to store and visualize the extracted triple. In the light of the constructed knowledge graph of power transformer operation and maintenance, the auxiliary decision-making function of power transformer operation and maintenance can be realized.

The ALBERT-BiLSTM-CRF model and ALBERT-BiLSTM-Attention model are used to conduct relation extraction experiments on the operation and maintenance texts of power transformers respectively. The accuracy of entity extraction using the ALBERT-BiLSTM-CRF model can reach 94.4%. The F1 score can reach 94.2%, which is 9.1% and 7.9% higher than BiLSTM-CRF respectively. The accuracy of ALBERT-BiLSTM-Attention model can reach 94.1%, and the F1 score can reach 95.1%, which are improved by 3.2% and 2.5% compared with the BiLSTM-Attention model. From the experimental results, it shows that the ALBERT pre-trained model has a good adaptability to extract entities and relations for power transformer operation and maintenance, and can better complete the task of knowledge extraction.

To sum up, this paper proposes a knowledge graph construction method of power transformer operation and maintenance based on ALBERT model. The main conclusions are as follows: ① A training dataset of power transformer operation and maintenance text is constructed based on Selenium framework and the sample generation method of regular matching, which effectively solves the difficult problem of obtaining data sets in the field of power transformer operation and maintenance. ② The ALBERT-BiLSTM-CRF model and ALBERT-BiLSTM-Attention model are used to extract entities and relations from the operation and maintenance texts of power transformers. Compared with the traditional deep learning model, ALBERT model can effectively overcome the problems in power transformer operation and maintenance texts, such as too many proper nouns, letters and symbols among Chinese characters. ③ Based on the constructed power transformer operation and maintenance knowledge graph, the operation and maintenance auxiliary decision-making function can be realized, which provides a new idea for the intelligent operation and maintenance of power transformers.

keywords:Power transformer, knowledge graph, deep learning, ALBERT, auxiliary decision

DOI:10.19595/j.cnki.1000-6753.tces.221751

中图分类号:TM41; TM391.1

谢 庆 男,1979年生,博士,教授,研究方向为人工智能在电力系统中的应用和高电压绝缘技术。E-mail:xq_ncepu@126.com

谢 军 男,1988年生,副教授,硕士生导师,主要研究方向为输变电设备状态智能评估、先进电工绝缘材料。E-mail:junxie@ncepu.edu.cn(通信作者)

国家重点研发计划资助项目(2020YFB0906000, 2020YFB0906005)。

收稿日期 2022-09-15

改稿日期 2022-10-25

(编辑 郭丽军)